Des premiers processeurs de l’informatique grand public, en passant par les cartes graphiques qui ont marqué un tournant technologique ou les composants incontournables, contemplons les trésors de silicium de ces 30 dernières années.

Quelle belle épopée que celle de l’informatique grand public ! De nos premiers boîtiers gris perle, où l’on transpirait à grosses gouttes en changeant les jumpers de place ou en modifiant les fichiers autoexec.bat et config.sys, à nos véloces PC actuels bardés de cores et de diodes RGB, un pas de géant a été franchi. Pour mieux saisir l’évolution, mais aussi pour titiller votre fibre nostalgique, nous vous proposons notre sélection des composants les plus marquants de ces 30 dernières années.

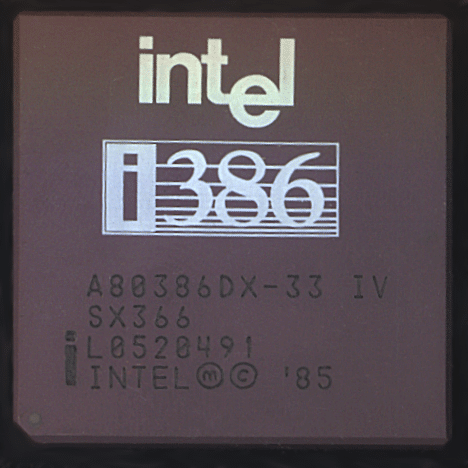

Intel i386

L’i386 (ou 80386) d’Intel fait son apparition en 1986. Premier processeur à implémenter l’architecture IA-32, il apporte un certain nombre d’avancées technologiques.

Son architecture 32 bits permet d’adresser jusqu’à 4 Go de mémoire de façon continue, son unité de pagination facilite l’utilisation de mémoire virtuelle et son mode 8086-virtuel permet des programmes en mode réel avec un système d’exploitation en mode protégé. C’est très certainement ce processeur CISC et surtout son architecture IA-32 – qui va devenir par la suite un standard de fait – qui vont permettre à Intel de devenir le géant qu’il est aujourd’hui…

Creative Labs Sound Blaster

La première Sound Blaster apparait en novembre 1989. Reprenant certaines des caractéristiques de la Creative Music System lancée deux ans auparavant, cette carte son embarque deux puces Philips SAA 1099 (capables de gérer jusqu’à 12 voies), un synthétiseur FM à 11 voies (Yamaha YM3812) et un microcontrôleur Intel MCS-51 (8051) capable de jouer un son mono de qualité radio (23 KHz) et d’enregistrer à 12 KHz. Cette carte possède également un port joystick et une interface MIDI.

Le rapide succès de cette carte son va la transformer ipso facto en un standard pour de nombreuses années. De nombreuses autres Sound Blaster vont par la suite voir le jour (SB 1.0, SB 1.5, SB 2.0, SB Pro, SB 16, …).

Intel 486 DX2/66

En août 1992, Intel lance son i486-DX2/66 (ou P24 pour les intimes). Comme l’ensemble de la gamme i486, ce processeur intègre un cache L1 unifié (instructions et données). L’i486-DX2 bénéficie par ailleurs d’une FPU intégrée et d’une horloge interne tournant à deux fois la fréquence de base de l’horloge externe.

L’i486-DX2/66 reste l’un des modèles les plus vendus de l’époque, et représentera pendant quelques années la configuration minimale recommandée de nombreux jeux vidéo.

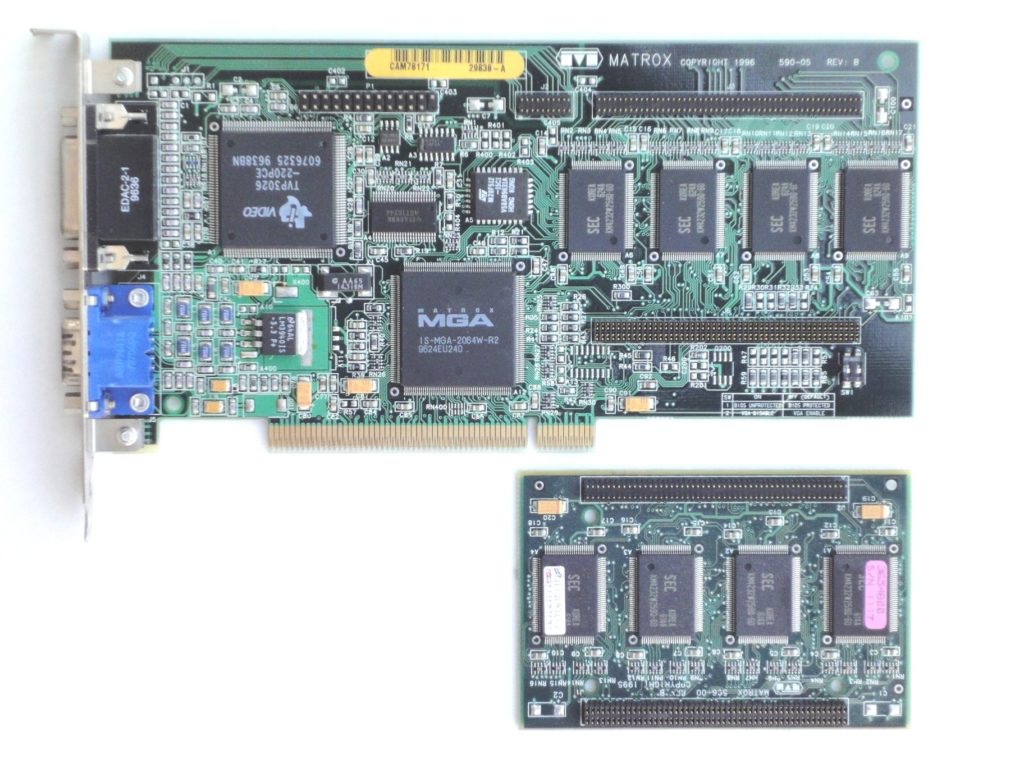

Matrox Millenium

En 1995, Matrox lance sa Millenium, une carte graphique qui va rapidement devenir une référence grâce à ses performances et sa qualité d’affichage.

Embarquant un accélérateur graphique MGA-2064W, un RAMDAC (à 175 MHz, 220 MHz ou 250 MHz selon les versions) et 2 Mo ou 4 Mo de mémoire WRAM sur un bus 64-bit, la Millenium pouvait accueillir de la mémoire supplémentaire (jusqu’à 8 Mo au total) grâce à un connecteur d’extension. Ce même port d’extension permettait également d’ajouter à cette carte graphique des fonctionnalités de capture d’images et d’accélérer la lecture de fichiers MPEG, grâce à un module Media-XL.

Cyrix 6×86 et M II

1995 : Cyrix lance son 6×86 et s’attaque au Pentium d’Intel. S’il est effectivement plus rapide que ce dernier en calculs sur des nombres entiers, ses performances en virgule flottante laissent en revanche à désirer. Qu’à cela ne tienne, le constructeur place son 6×86 à un tarif extrêmement concurrentiel, ce qui en fera un succès commercial en entrée de gamme.

Suivront en 1997 le 6x86MX, une version compatibles avec le nouveau jeu d’instruction MMX d’Intel, puis le M II, un 6x86MX renommé et légèrement remanié, mais avec des fréquences – et un PRating – plus élevées.

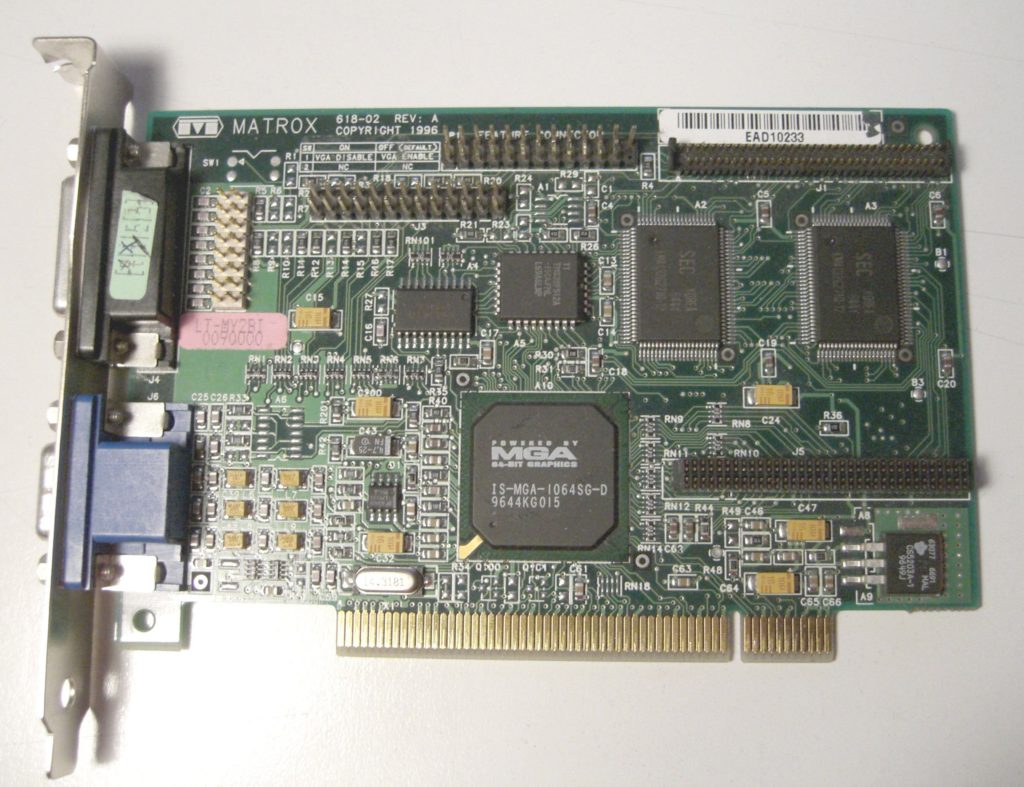

Matrox Mystique

La Mystique de Matrox est apparue sur le marché en 1996. Basé sur un accélérateur 2D (MGA1064SG), elle fait également office d’accélérateur 3D. Utilisant de 2 Mo à 8 Mo de mémoire SGRAM sur une interface 64-bit, la Mystique pouvait accueillir des cartes d’extension : les Rainbow Runner Video (lecture vidéo MPEG-1 et AVI, entrées et sorties vidéo) et Rainbow Runner TV (tuner TV). On trouvait également un RAMDAC interne à 170 MHz.

La Mystique ne prenait en revanche pas en charge le filtrage bilinéaire, à l’inverse de la Voodoo de 3Dfx. Elle offrait toutefois des performances supérieures à celles des S3 ViRGE et ATI Mach64 de l’époque, mais avec une qualité d’affichage 3D inférieure. Matrox lancera en 1997 la Mystique 220, avec une puce MGA1164SG et un RAMDAC à 220 MHz.

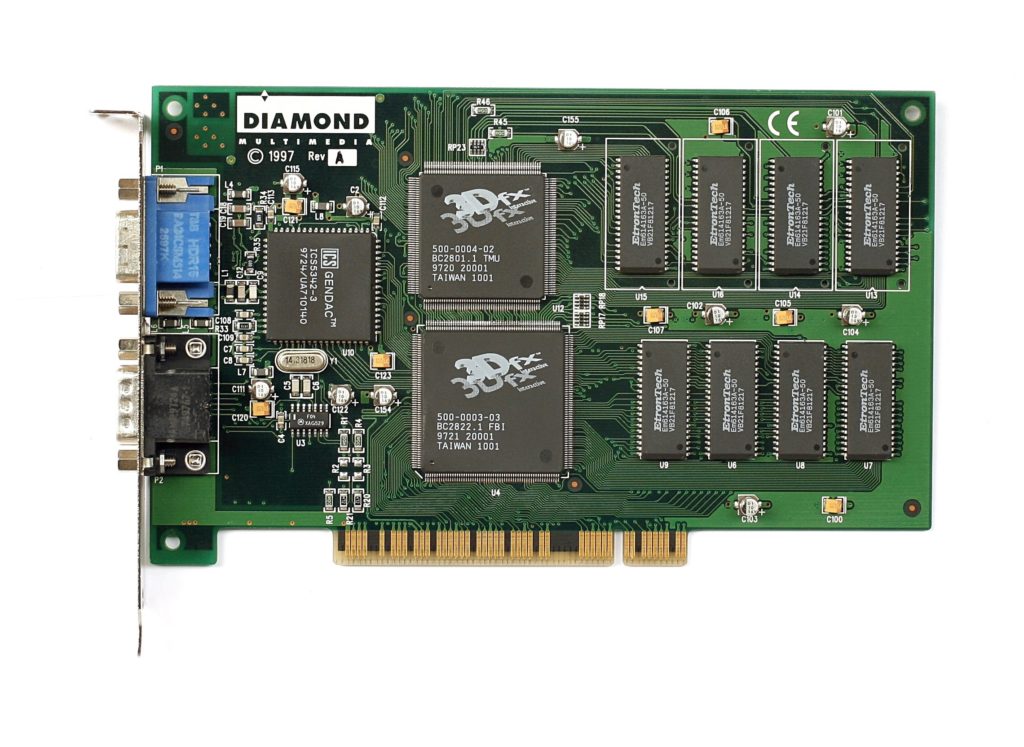

3Dfx Voodoo Graphics

Présentée le 6 novembre 1995 lors du COMDEX, c’est finalement en 1996 que 3Dfx lance sa puce graphique Voodoo Graphics. Cadencée à 50 MHz, celle-ci apporte le filtrage bilinéaire aux jeux vidéo de l’époque. L’organisation de la mémoire était assez atypique : une partie était dédiée à l’affichage (frame buffer, généralement 2 Mo), tandis qu’une autre partie (très souvent 2 Mo également) était utilisée pour stocker les textures.

Des tarifs agressifs et des performances intéressantes vont permettre à cet accélérateur 3D (qui nécessitait une carte graphique additionnelle pour prendre en charge l’affichage 2D classique) de concurrencer efficacement les autres carte graphiques de l’époque : Matrox Mystique, S3 ViRGE ou encore ATI 3D Rage. De très nombreux jeux étaient capables d’utiliser l’API Glide, propre aux puces de 3Dfx.

Intel Pentium MMX

Lancé le 22 octobre 1996, mais réellement disponible à partir du début de l’année suivante, le Pentium MMX (P55C) est une évolution du célèbre Pentium d’Intel.

Le P55C a été commercialisé avec des fréquences comprises entre 120 MHz et 233 MHz, en format CPGA ou PPGA, et avec des tensions et finesses de gravure diverses. Ce processeur apporte 57 nouvelle instructions « MMX », orientées multimédia, au jeu d’instructions x86. Le cache L1 passe quant à lui de 16 Ko sur le Pentium à 32 Ko sur la version MMX. Aujourd’hui largement dépassé, ce processeur a toutefois pendant très longtemps représenté la configuration minimale pour de nombreux jeux vidéo. Qui ne se souvient pas du célèbre Pod, un jeu de course futuriste présentant de nombreuses optimisations, notamment pour les Pentium MMX ?

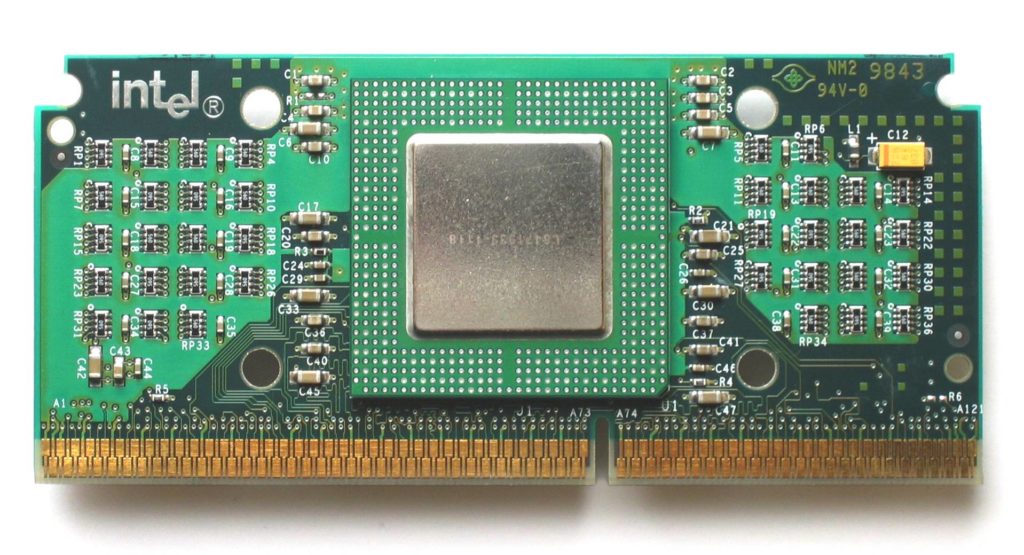

Intel 440BX

Avril 1998 : Intel lance son northbridge 82443BX, plus connu sous le nom de chipset 440BX. Destiné aux Pentium II et Celeron sur Slot 1 (plus tard en socket 370), celui-ci succède aux 440FX et 440LX.

Accompagné par son fidèle southbridge PIIX4E (Intel 82371EB), c’est le premier chipset Intel à supporter un bus à 100 MHz. Il se montrera rapidement très doué en overclocking, le FSB étant facilement overclockable à 133 MHz. Seul problème, le bus AGP était alors également overclocké – ce qui pouvait parfois poser quelques soucis à certaines cartes graphiques – en raison de l’absence de diviseur ½ sur ce bus. Cela ne l’empêchera pas de rencontrer un succès certain et d’être utilisé très longtemps par de nombreuses cartes mères.

Intel Celeron 300A

Initialement lancé le 15 avril 1998 dans une version dépourvue de cache L2 (Covington), le Celeron ne va acquérir ses lettres de noblesse qu’avec la version Mendocino. Basé sur le Pentium II, il s’agit du premier processeur grand public à intégrer le cache L2 (128 Ko) sur le même die que le processeur.

L’un des Celeron les plus connus reste sans doute le 300A. Abordable comme tous les autres Celeron (surtout par rapport au Pentium II), le Celeron 300A était également facilement overclockable. Il n’était en effet pas rare de voir des modèles supporter un FSB de 100 MHz, contre 66 MHz par défaut. La fréquence du processeur passait alors de 300 MHz à 450 MHz (presque) sans le moindre effort, décuplant par la même occasion un rapport performances/prix déjà très intéressant.

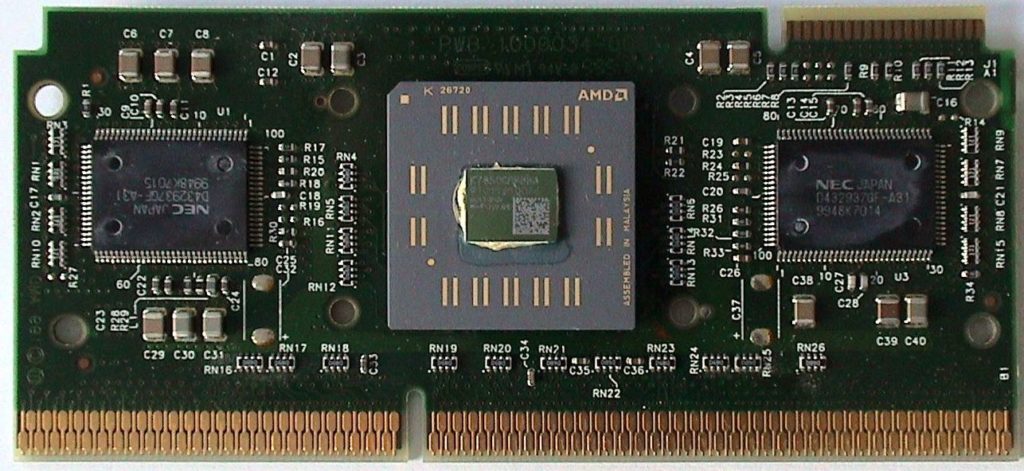

AMD Athlon (K7)

L’Athlon, ou K7 (Argon), apparait le 23 juin 1999 au catalogue d’AMD. Utilisant un connecteur de type Slot A, ce processeur est tout d’abord gravé en 0,25 microns et cadencé à une fréquence de 500 à 700 MHz. Rapidement, l’Athlon bénéficie d’une gravure en 0,18 microns permettant une montée en fréquence jusqu’à 1 GHz, barre qu’il est le premier à atteindre.

Concurrent du Pentium III d’Intel, l’Athlon succède au K6. Il possède trois ALU, trois FPU indépendantes, trois décodeurs chargés de convertir les instructions x86 en micro-instructions, un pipeline à 10 étages et un cache L1 de 2 x 64 Ko. Ce processeur utilise par ailleurs un bus EV6 « DDR », développé par DEC pour son Alpha. Ces caractéristiques permettront à l’Athlon de tenir tête au Pentium III pendant de nombreux mois.

NVIDIA GeForce 256

Annoncée le 31 août 1999 par NVIDIA, la GeForce 256 fait son apparition le 11 octobre de la même année. C’est la première carte graphique grand public à offrir le support du Transform and Lighting (TnL) et à utiliser un « GPU » (Graphics Processing Unit) selon les termes de NVIDIA.

Basée sur un chipset NV10 cadencé à 120 MHz et dotée de 32 ou 64 Mo de mémoire SDR-166 ou DDR300 sur un bus 128 bits, cette carte graphique possède quatre unités de texturing et un moteur de décompression MPEG-2 matériel. C’est également la première carte entièrement compatible avec l’API Direct3D 7.0. Le chipset NV10, décliné en version « GL » sur les cartes Quadro, permettra enfin à NVIDIA de faire son apparition sur le marché de la CAD.

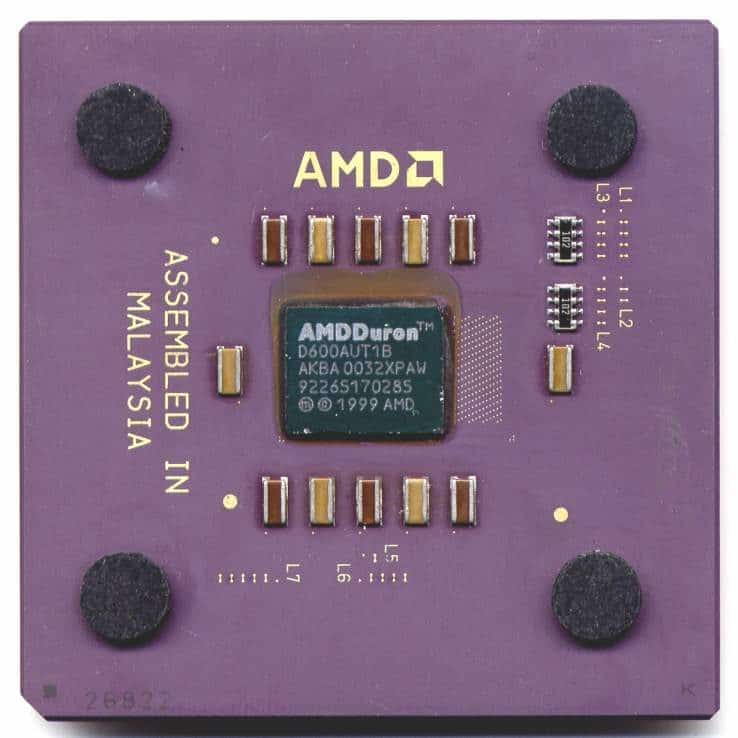

AMD Duron

Afin de proposer un processeur plus abordable que l’Athlon, AMD lance le 19 juin 2000 une version « low-cost » de celui-ci : le Duron.

Reposant sur la même architecture et entièrement compatible avec le socket A de son grand frère, ce processeur utilise au début un FSB à 100 MHz (contre 133 MHz pour les premiers Athlon en socket A) et dispose de seulement 64 Ko de cache L2 (alors que l’Athlon en socket A en embarque 256 Ko). La gestion exclusive du cache et un cache L1 de 128 Ko permet toutefois au Duron de conserver des performances honorables, surtout compte tenu de son prix agressif. Certains Duron (plus exactement les premiers Applebred) pouvaient par ailleurs aisément être retransformés en Athlon en réactivant leur cache L2, pourvu que celui-ci ne soit pas défectueux. L’overclocking se faisait au moyen d’un simple crayon à papier et permettait souvent de franchir la barre des 900 MHz, contre 600, 650 ou 700 MHz d’origine.

Intel Pentium 4

2000 : difficile de passer à côté du Pentium 4, et de ses promesses – à l’époque – d’atteindre à terme la barre des 10 GHz grâce à son architecture Netburst révolutionnaire et à son pipeline d’une longueur interminable.

Si Intel a vite déchanté quant aux fréquences à cause (entre autres) des courants de fuite et de la dissipation thermique, il n’en reste pas moins que ce processeur est le premier à apporter le SMT dans le monde x86, renommé Hyper-Threading chez le constructeur, à partir de Northwood. Il s’agit également de la première véritable nouveauté en matière de micro-architecture depuis le P6 (ou Pentium Pro) chez Intel. Notons enfin que c’est avec le Pentium 4 que le SSE2 a fait son apparition.

NVIDIA GeForce 3 Ti

Première carte de NVIDIA à supporter l’API Direct3D 8.0, les Vertex Shader 1.1 et les Pixel Shader 1.1, la GeForce 3 Ti fait son apparition en mars 2001. C’est la première carte à être équipée d’unités programmables permettant d’utiliser les désormais fameux « shaders ». Embarquant un chipset NV20 cadencé à 200 MHz, elle possède quatre pixel pipelines et affiche un fillrate de 1,6 GTexel/s. La GeForce 3 apporte par ailleurs de nouveaux modes d’anti-aliasing, plus performants, et des optimisations au niveau de la gestion de la mémoire (Lightspeed Memory Architecture).

La GeForce 3 fut par la suite déclinée en version Ti200 (GPU cadencé à 175 MHz) et Ti500 (GPU fonctionnant à 240 MHz) afin de concurrencer les Radeon 8500 et Radeon 7500 d’ATi.

PowerVR Kyro II

Alors que tout le monde est encore en train de rêver à la GeForce 3 Ti, voici que PowerVR dévoile le Kyro II, un chipset graphique aux fonctionnalités « révolutionnaires », permettant selon le slogan même du constructeur d’offrir les performances d’une GeForce 2 GTX au prix d’une GeForce 2 MX.

Avec des performances brutes largement inférieures aux puces de son époque, le Kyro II tire son épingle du jeu avec une fonctionnalité « magique » : le Tile Rendering. L’idée est relativement simple : déterminer si un pixel sera ou non visible à l’écran avant d’en effectuer le rendu, et économiser de la puissance et de la bande passante si ce n’est pas le cas. L’absence de support du Transform & Lightning – et donc de DirectX 7.0 – sonnera hélas le glas de cette puce…

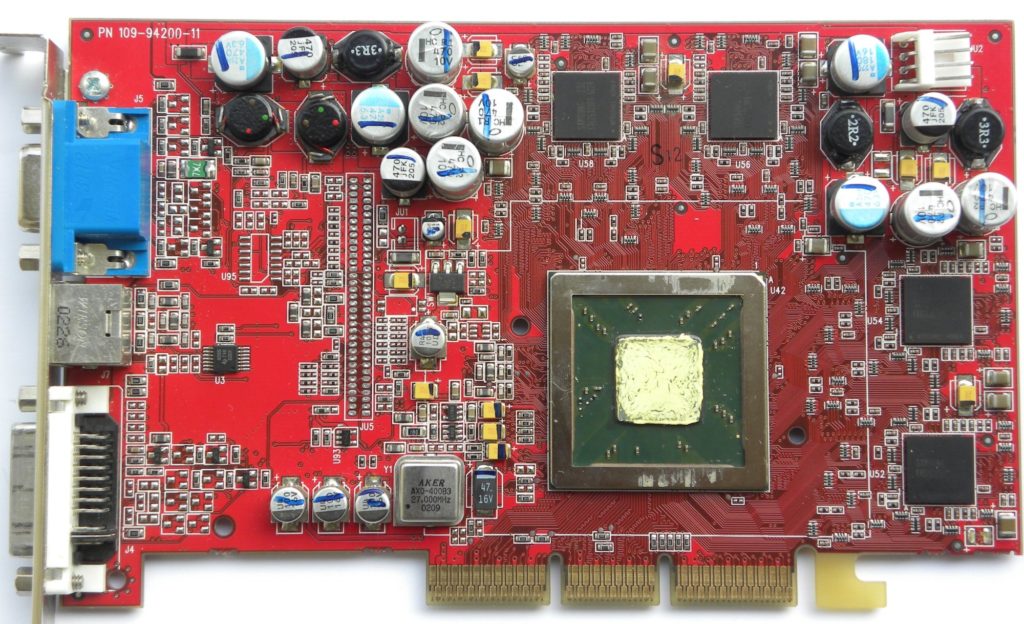

ATi Radeon 9700 Pro & 9500 Pro

Lancée en juillet 2002, la Radeon 9700 Pro est la première carte à supporter l’API Direct3D 9.0, alors que cette API n’est même pas encore officiellement lancée par Microsoft. Elle utilise un chipset R300 (baptisé VPU, pour concurrencer le GPU de NVIDIA), gravé en 150 nm – une technologie bien maîtrisée à l’époque – et cadencé pour l’occasion à 325 MHz.

Celui-ci possède 8 unités de texture (16 textures par passe), 8 ROPs, huit pixel pipelines et quatre vertex pipelines. Dotée de 128 Mo de mémoire DDR fonctionnant à 310 MHz sur un bus 256 bits, la Radeon 9700 Pro affiche un fillrate de 2,6 Gpixels/s et une bande passante mémoire de 19,8 Go/s. Surpassant les GeForce4 Ti de NVIDIA, cette carte s’impose facilement sur le segment haut de gamme, malgré un tarif supérieur à ses concurrentes.

Après la Radeon 9700 Pro, c’est au tour de la Radeon 9500 Pro de faire son apparition en octobre 2002. Si le chipset R300 qui équipe cette Radeon 9500 Pro est identique à celui de la Radeon 9700 Pro, il n’est en revanche cadencé qu’à 275 MHz. La mémoire DDR tourne de son côté à 270 MHz et le bus mémoire est limité à 128 bits. Cette économie se ressent donc sur la bande passante mémoire qui n’atteint plus que 8,6 Go/s, mais le fillrate reste assez élevé (2,2 Gpixels/s). Moins chère mais aussi performante que les GeForce4 Ti de NVIDIA, cette carte graphique rencontre un succès certain, d’autant plus qu’elle est supporte l’API DirectX 9.0 contrairement à ses concurrentes. Le R300 et ses déclinaisons resteront au catalogue d’ATI pendant trois ans.

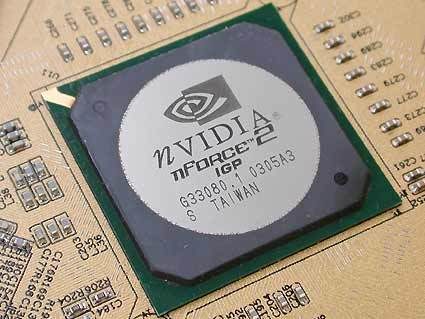

NVIDIA nForce2

Présenté en juillet 2002 par NVIDIA, le chipset nForce2 a été utilisé par de très nombreuses cartes mères pour processeurs Athlon en socket A. C’est le premier chipset grand public à prendre en charge la mémoire sur deux canaux, améliorant significativement la bande passante mémoire. Ceci s’avérera particulièrement utile à l’IGP (GeForce4 MX) intégré à certaines versions du chipset nForce2.

Deux southbridges différents accompagnaient le nForce2 : le MCP et le MCP-T. Le MCP était doté d’un contrôleur Ethernet 100 Mbps et d’un audio AC97 alors que le MCP-T bénéficiait de deux contrôleurs Ethernet 100 Mbps et d’un contrôleur audio NVAPU (plus connu sous le nom de SoundStorm). Supportant officiellement un FSB maximum de 166 MHz et la mémoire DDR-333, le nForce2 fut suivi par le nForce2 Ultra 400. Celui-ci apportera la gestion officielle du FSB à 200 MHz et de la DDR-400.

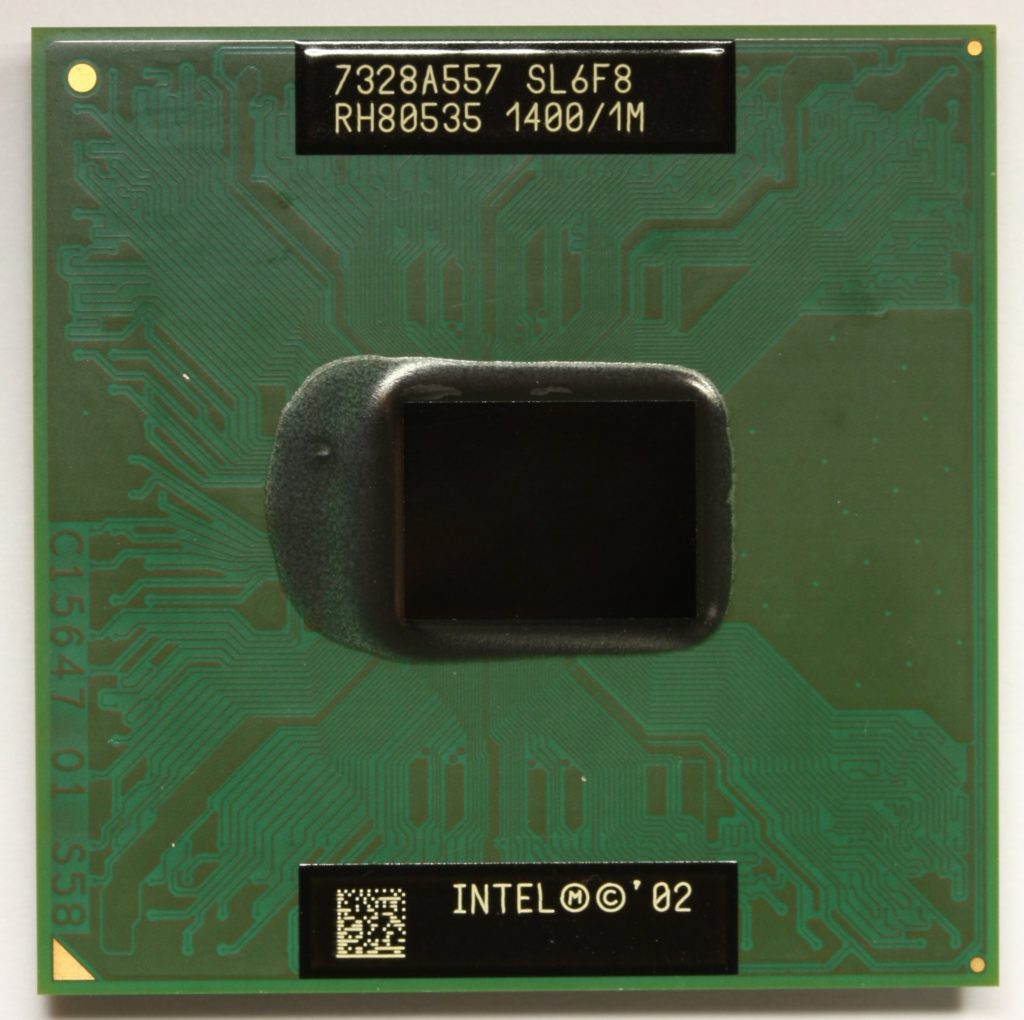

Intel Pentium M

Le Pentium M fait son apparition en mars 2003. Il a été conçu pour remplacer les Pentium 4M, ces derniers affichant une consommation et un dégagement thermique excessif, inadaptés à une utilisation nomade.

Ce processeur est dérivé de l’architecture P6 avec – entre autres – un système de prédiction de branchement amélioré, mais il reprend le bus quad pumped et les instructions SSE2 du Pentium 4. La technologie EIST est également de la partie afin d’optimiser la consommation du processeur. Les premiers Pentium M Banias sont gravés en 130 nm, mais rapidement le Dothan gravé en 90 nm fait son apparition. Le Pentium M est par ailleurs à l’origine du label Centrino qui connaîtra un certain succès auprès du grand public.

Western Digital Raptor

En 2003, Western Digital lance le premier disque dur grand public à utiliser des plateaux (un seul au début) fonctionnant à 10 000 tours par minute : le Raptor.

D’une capacité de 37 Go, le WD360GD utilise une interface SATA. Néanmoins, les premiers modèles embarquent un pont PATA/SATA Marvell 88i8030C-TBC (UDMA5) limitant les débits à environ 104 Mo/s. A partir de décembre 2003, le constructeur livre des modèles de Raptor équipés d’un pont 88i8030-TBC1 (UDMA6) permettant d’atteindre des débits de 122 Mo/s. Les performances impressionnantes (pour l’époque) du Raptor assureront son succès auprès des « power users », même s’il visait également les serveurs d’entrée de gamme.

AMD Athlon 64 (K8)

Le 23 septembre 2003, AMD lance ses très attendus processeurs Clawhammer et Sledgehammer, dévoilant par la même occasion son architecture K8.

Commercialement baptisés Athlon 64 et Athlon 64 FX, ces processeurs apportent des améliorations significatives par rapport à l’architecture K7. Ils intègrent en effet un contrôleur mémoire (simple ou double canal selon les modèles et sockets) et utilisent un bus HyperTransport. Le pipeline passe à 12 étages, la gestion du cache L2 est améliorée et le NX bit fait son apparition. Gravés en 130 nm, les Athlon 64 et 64 FX sont également les premiers processeurs grand public compatibles x86-64, un jeu d’instructions qu’Intel reprendra par la suite en le rebaptisant EM64T, puis Intel 64.

AGEIA PhysX

En 2005, la société AGEIA lance un gros pavé dans la marre en dévoilant son PPU, ou Physics Processing Unit, baptisé PhysX. À la manière d’un GPU accélérant le rendu 2D et surtout 3D, le PPU accélère les calculs physiques, soulageant par la même occasion le processeur.

La carte additionnelle PhysX embarque 125 millions de transistors et 128 ou 256 Mo de mémoire GDDR3, mais son succès commercial ne sera pas vraiment au rendez-vous en raison de son tarif élevé. Il faudra attendre le rachat d’AGEIA par NVIDIA en 2008 et surtout l’intégration du moteur PhysX dans les GeForce 8 pour que la technologie décolle enfin, rendant au passage inutile la carte additionnelle…

Intel Core 2 Duo

Lancés le 27 juillet 2006, les premiers processeurs Core 2 Duo (Conroe) étaient gravés en 65 nm. Inspirée de l’architecture Yonah, l’architecture Core des processeurs Core 2 Duo peut être considérée comme la lointaine (et dernière) évolution de l’architecture P6 d’Intel.

Chaque cœur d’un processeur Core 2 Duo possède trois ALU et trois unités SSE, une unité d’exécution OoO ainsi que 2 x 32 ko de cache L1. L’architecture Core apporte par ailleurs un mécanisme de prédiction des conflits mémoires, un système de macro-fusion des instructions permettant d’accélérer le décodage et le suivi de certaines instructions, et la possibilité de désactiver de manière sélective certaines unités afin d’économiser l’énergie.

Destinés à remplacer les processeurs Pentium 4 et Pentium D (et leur architecture Netburst), ces processeurs dual-core rencontrent un véritable succès grâce à leurs performances associée à leur faible consommation (surtout par rapport aux Pentium 4 et D).

NVIDIA GeForce 8800 GT

Les GeForce 8 sont les premières cartes NVIDIA à supporter l’API Direct3D 10, les Shader Model 4.0 et l’API OpenGL 3.3. Utilisant initialement un chipset G80 (et ses dérivés), les cartes graphiques de cette gamme bénéficient rapidement du chipset G92. La GeForce 8800 GT, lancée le 29 octobre 2007, est la première GeForce à utiliser ce nouveau chipset gravé en 65 nm, plus économe en énergie et moins cher à produire que le G80.

Cadencé à 600 MHz, le G92-200 de cette carte possède 112 Stream Processors tournant à 1500 MHz et 56 unités de texturing. Avec sa mémoire GDDR3 fonctionnant à 900 MHz, la GeForce 8800 GT affiche une bande passante de 57,6 Go/s. A sa sortie, cette carte graphique sera bien accueillie par les joueurs grâce à son excellent rapport qualité/prix. Son chipset G92 sera par la suite utilisé dans de nombreuses autres cartes.

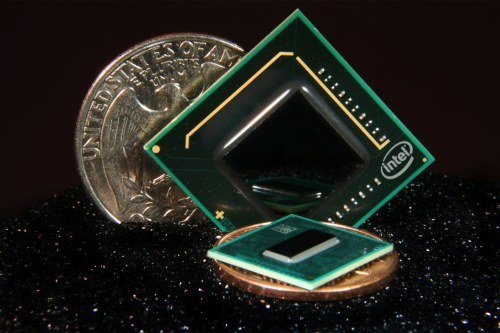

Intel Atom

Intel lance en avril 2008 son premier processeur Atom : le Silverthorne. Basé sur l’architecture Bonnel, celui-ci vise le marché des MID (Mobile Internet Device). En juin 2008, le fondeur lance ses processeur Atom N270 et Atom 230, des modèles « Diamondville » également basés sur l’architecture Bonnel mais cette fois-ci destinés aux nettops et netbooks.

Particulièrement économes en énergie, ces processeurs n’ont pas été conçus pour être des monstres de puissance mais plutôt pour améliorer l’autonomie. Les fréquences s’échelonnent au début entre 800 MHz pour le Z500 (avec un TDP de seulement 0,65W) et 1,86 GHz pour le Z540 (et un TDP de 2,4W). Le succès des netbooks a transformé l’Atom en véritable succès commercial, avant que les ventes de netbooks (et donc de processeurs Atom) ne chutent avec la concurrence des tablettes tactiles.

AMD Radeon HD 4870 & 4850

AMD lance sa Radeon HD 4870 le 25 juin 2008. Basée sur un chipset RV770 gravé en 55 nm, celle-ci vient concurrencer les GeForce 200 Series que NVIDIA vient tout juste de lancer sur le marché.

Supportant les API Direct3D 10.1, OpenGL 3.3 et OpenCL 1.0, la Radeon HD 4870 embarque un GPU cadencé à 750 MHz et doté de 800 Stream Processors, 40 unités de texture et 16 ROPs. C’est également le premier GPU à prendre en charge la mémoire GDDR5. La Radeon HD 4870 bénéficie par ailleurs d’un nouveau moteur de décompression matérielle UVD2, prenant en charge les flux MPEG-2, H.264/MPEG-4 AVC et VC-1. Grâce à un rapport/performances prix intéressant et une consommation raisonnable, la Radeon HD 4870 sera très bien accueillie par les joueurs.

En même temps que la Radeon HD 4870, AMD lance la Radeon HD 4850. Elle aussi équipée d’un chipset RV770, mais avec une fréquence un peu moins élevée (625 MHz), cette carte graphique est elle-aussi très appréciée pour ses performances honorables, son tarif relativement abordable et sa consommation limitée.

La Radeon HD 4850 reprend toutes les caractéristiques de la HD 4870 (support des API Direct3D 10.1, OpenGL 3.3 et OpenCL 1.0, 800 Stream Processors, 40 unités de texture, 16 ROPs et moteur vidéo UVD 2), mis à part du côté de la mémoire. Cette carte graphique doit en effet se contenter de mémoire GDDR3 (ou GDDR4) sur un bus 256-bit.

Intel X18-M et X25-M

Intel lance ses premiers SSD grand public le 8 septembre 2008. Les X18-M et X25-M (nom de code Ephraim), disponibles en versions 80 Go et 160 Go, utilisent de la mémoire MLC gravée en 50 nm et un contrôleur Intel. Ils seront suivis, le 15 octobre de la même année, par le X25-E (32 et 64 Go). Équipé de mémoire SLC (plus chère mais censée être plus endurante que la mémoire MLC), ce SSD est destiné au marché des entreprises.

Dotés d’une interface SATA 3 Gbps, les X18-M et X25-M sont capables d’atteindre des débits de l’ordre de 250 Mo/s en lecture séquentielle et de 70 Mo/s en écriture séquentielle. Ces performances honorables pour l’époque vont contribuer à leur succès.

NVIDIA GeForce GTX 460

La GeForce GTX 460 fait partie des premières cartes graphiques NVIDIA à supporter les API Direct3D 11.0, OpenGL 4.3 et OpenCL 1.1, ainsi que les Shader Model 5.0. Lancée le 12 juillet 2010, soit près de quatre mois après les premières GeForce 400 Series, la GTX 460 permet à NVIDIA de proposer une carte réellement compétitive face aux Radeon HD 5000, avec un rapport performances/prix intéressant.

Cette carte embarque un chipset GF104 « Fermi » cadencé à 675 MHz et équipé de 336 Stream Processors fonctionnant à 1350 MHz et de 56 TMUs. L’ensemble est accompagné par 768 Mo ou 1024 Mo de mémoire GDDR5 (sur un bus 192 ou 256-bit) cadencée à 900 MHz. En septembre 2011, la GeForce GTX 460 a bénéficié d’une cure de rajeunissement, avec un nouveau chipset graphique (le GF114) et des fréquences revues à la hausse (778 MHz pour le GPU, 1556 pour les CUDA Cores et 1002 MHz pour la mémoire GDDR5).

Intel Sandy Bridge

Voici les Sandy Bridge d’Intel : lancés en janvier 2011, ces processeurs sont déclinés à toutes les sauces (entrée, milieu et haut de gamme, en versions desktop, mobile et serveur).

Gravés en 32 nm, ils bénéficient de nombreuses avancées par rapport aux Westmere précédents : cache « L0 » contenant 1500 micro-opérations décodées, circuit graphique intégré au die, Turbo Boost amélioré ou encore technologie Quick Sync. Les parts de marché d’Intel parlent d’elles-mêmes : le Sandy Bridge est une réussite commerciale et technologique.

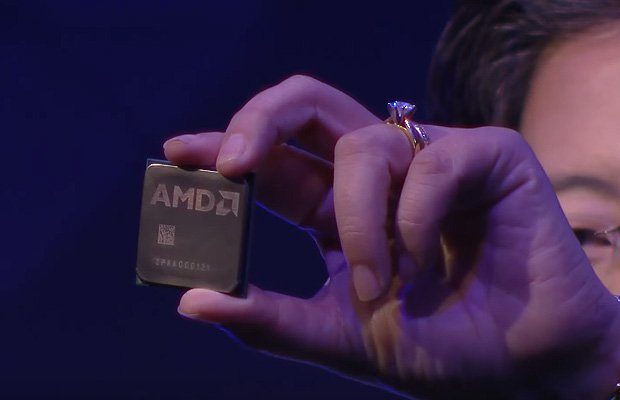

AMD Zen

L’architecture Zen signe le retour en force d’AMD face à Intel. Un retour qui fut cependant progressif, car les deux premières générations de processeurs Ryzen / Threadripper / EPYC étaient perfectibles. Mais depuis l’arrivée des Ryzen 3000 sur architecture Zen2, AMD est clairement revenu dans la course, en proposant aussi le tout premier CPU grand public en structure “chiplet”. Sans oublier une autre première : la gestion du PCI Express 4.0. Du coup, tout le monde attend avec impatience la prochaine mouture Zen3 avec les Ryzen 4000 Desktop dans quelques mois, qui promet d’être encore plus rapide !

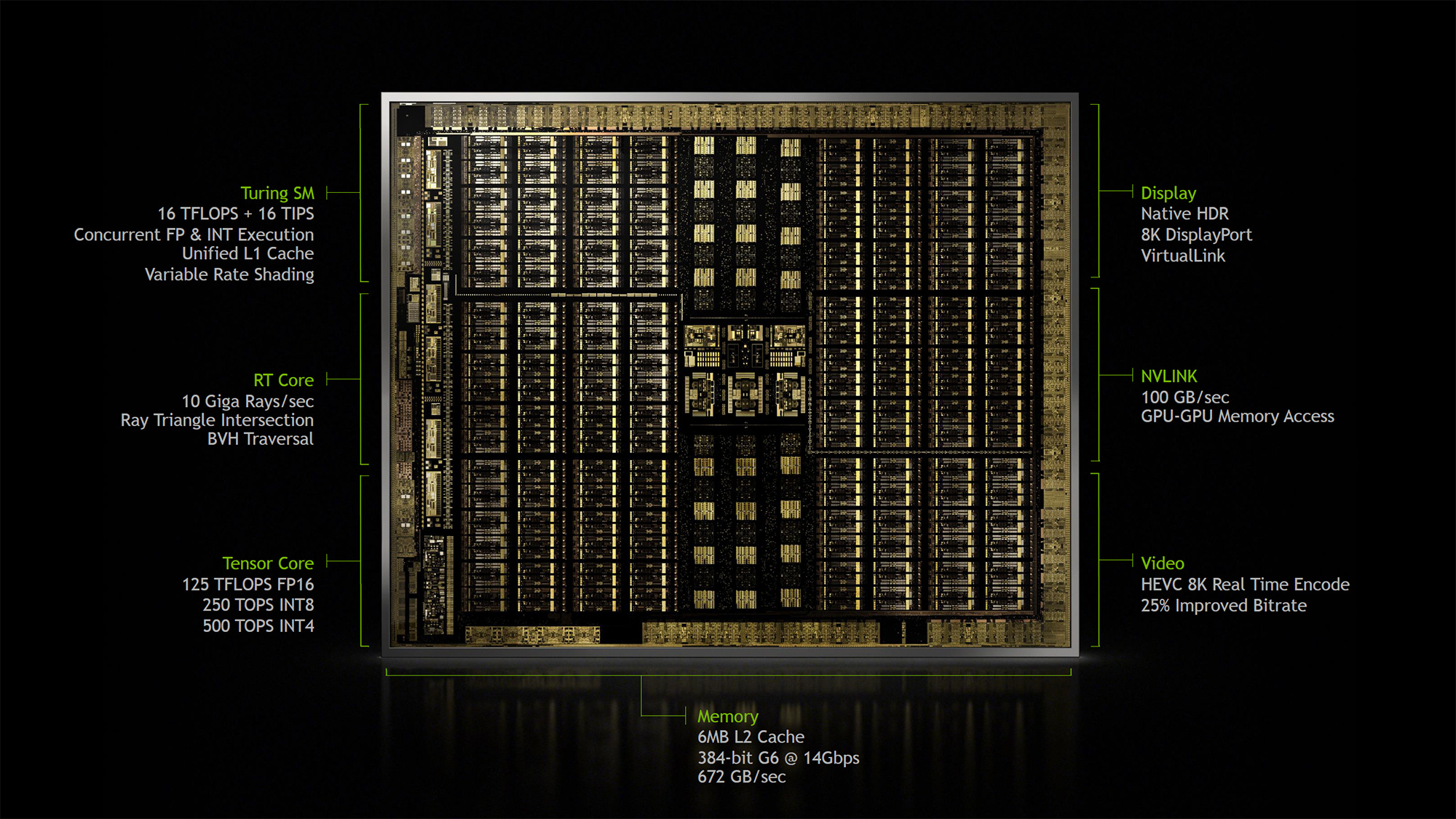

NVIDIA GeForce RTX (Turing)

Avec son GPU Turing, NVIDIA aura été premier sur l’accélération du ray tracing en matériel grâce à des coeurs RT dédiés. Et pas seulement : il s’agit aussi du premier GPU grand public intégrant des coeurs Tensor pour accélérer l’inférence IA ! Deux énormes innovations qui tracent la route du futur, puisqu’après quelques mois de scepticisme, tous les développeurs se sont mis au ray tracing en temps réel. Aujourd’hui, tout le monde s’accorde à dire que le ray tracing (hybride, partiel, puis pourquoi pas complet) sera l’avenir du rendu 3D dans les jeux vidéo.

Et la carte son adlib? C’est elle qui avant toutes les autres a démocratisé le son sur PC! La soundblaster l’a détrônée… mais on peut prendre la carte adlib et éventuellement la Roland MT-32 (l’une en “entrée de gamme” et l’autre en “carte de luxe”)

C’est totalement vrai, mais SoundBlaster est tellement emblématique… On se concentre sur les produits qui ont marqué le marché grand public. J’ai encore une AWE32 dans les placards…

Moi, sur une étagère de mon bureau, a coté d’une mobo Mini- AT avec un AMD DX-40 MHz et d’un DD Quantum Fireball …

J’en conviens… ceci dit c’est la Adlib qui a permis d’accéder au son “audible” sur un PC, d’où une nostalgie bien réelle! La majorité des jeux supportaient la Adlib, par la suite la soundblaster, et le tout complété de temps en temps par la légendaire Roland MT32

L’interface MIDI n’en ai pas réellement une sur la Soundblaster, tout passe par le port joystick et il fallait acheter un adaptateur à l’époque pour avoir de vraies prises MIDI.

En plus si tu voulais jouer il fallait l’enlever pour rebrancher le joystick…

Sinon sympa ce dossier, cela rappelle de bons et mauvais souvenirs, quelle galère parfois pour faire reconnaître sa carte son dans tel ou tel jeu !

Pour le Chipset BX là… l’overclocking était surtout fait en passant les processeurs de 66 à 100Mhz. Le Celeron 266 passait ainsi à 400Mhz les doigts dans le nez, et le Celeron 300 à 450Mhz. On se retrouvait avec des bêtes de course pour pas un rond.

Rappelons qu’il fallait scotcher la piste B21 (si je me souviens bien…) du Slot 1 pour permettre d’overclocker convenablement 🙂

Légendaire, il ne faudrait pas se limiter aux PC sous Windows/DOS. La série 68000 est tout aussi légendaire et à l’origine de pas mal de plateformes (plus) sympas que le PC/DOS dans les années 80 (Atari, Amiga, Apollo …). Le Z80 aussi !

Et le PowerPC a pas été dégueux a certaines étapes (PPC 601, PPC750 …)

Je pense que l’article ne parle clairement que du PC sous sa forme actuelle, qui d’ailleurs est la même depuis IBM (Personnal Computer). C’est ce qui le distingue des machines que tu cites, au titre qu’on vendait à l’époque des PC dits “PC compatibles”‘ (comprendre compatibles avec le modèle source de chez IBM)

Les 3DFX et GeForce256 ont toutes deux pavées la voie au gaming en 3D et méritent leur place. Je n’en dirait pas autant des Matrox (Mystique et Millenium) qui même si elles ont été poulaires n’ont pas marqué durablement les esprits.

Les 386 et 486 étaient intéressant en version DX, avec coprocesseur mathématique, contrairement aux SX. La différence était flagrante, surtout dès que la 3D était impliquée.

Le Pentium MMx a surtout eu son heure de gloire à cause de la campagne marketing frisant le ridicule de la part d’Intel (le MMX accèlere l’internet, rappelez vous…). Côté performance c’était moins marquant. Le celeron 300A a permis à beaucoup de s’équiper moins cher et d’overclocker facilement

Les processeurs Cyrix avaient l’avantage du faible prix, mais aussi d’un retard flagrant sur Intel et AMD en terme de performances. Ça a été le processeur de prédilection des assembleurs pour les machines “cheap”.

Pas tout à fait de mon point de vue. Historiquement la Geforce 256 est postérieure aux cartes accélératrices qui ont lancé le débat, à savoir les trois générations de Voodoo de chez 3Dfx -en notant bien que la génération 2 incluait le concept de SLI… que Nvidia s’est empressé de racheter au moment du naufrage de 3Dfx-, les gammes Matrox Gxxx (G200 et G400), ainsi que les gammes TNT 1 et 2 de chez Nvidia. On avait dans le même temps aussi les ATI Rage (puis par la suite la série Radeon)

La Geforce 256 a surtout et avant tout été un énorme pas en avant technologique concernant son support extrêmement puissant et efficace de DirectX (là où 3dFX faisait sa propre soupe avec “Glide”), ainsi que la mère d’une manière de concevoir ce qu’est une CG, à savoir un produit toujours plus puissant, embarquant énormément de Ram, et pouvant carrément remplacer de la puissance concrète de CPU!