Une mémoire munie de ses propres unités de calcul, pour des systèmes jusqu’à deux fois plus performants et consommant 70 % d’énergie en moins.

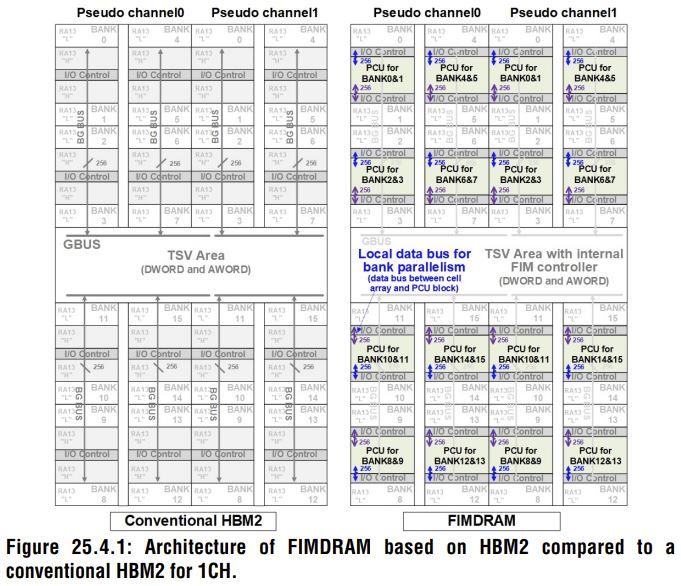

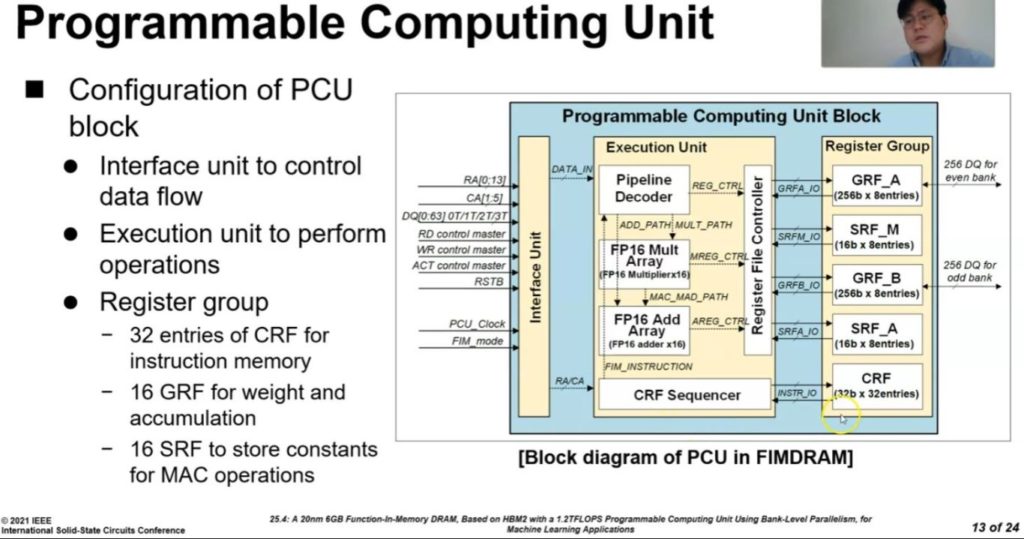

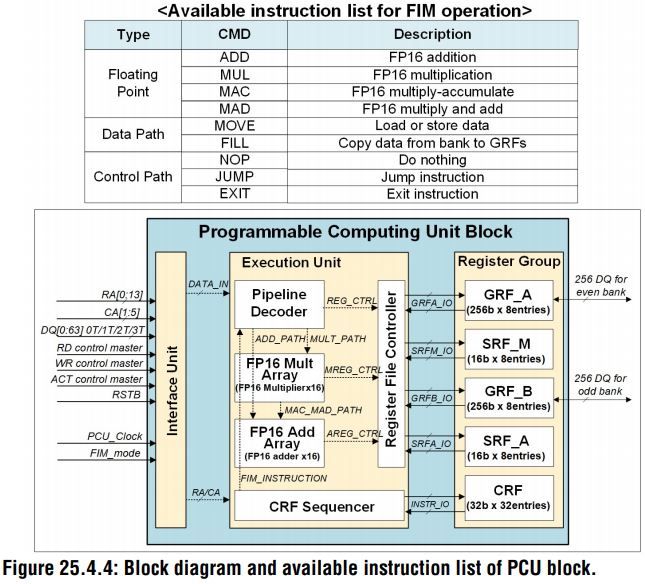

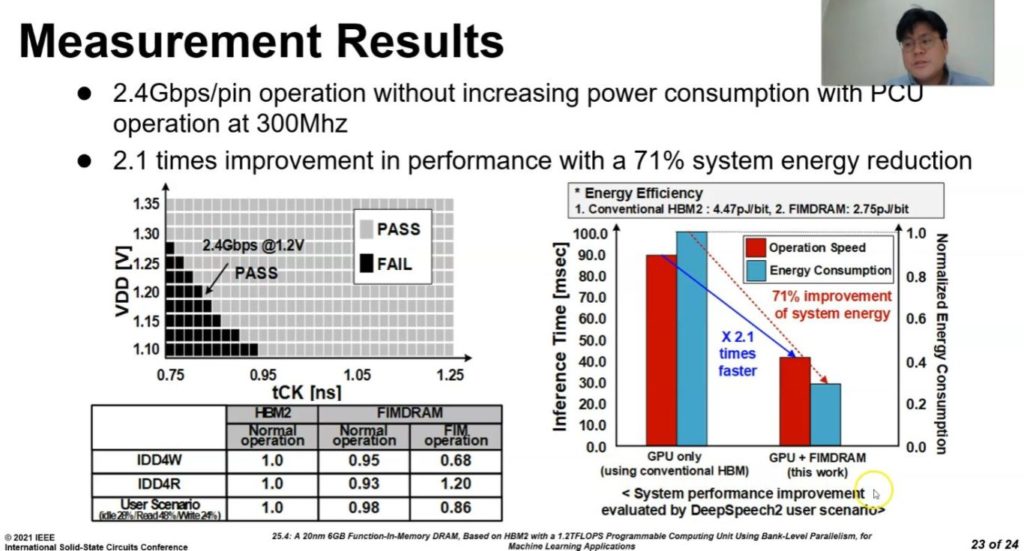

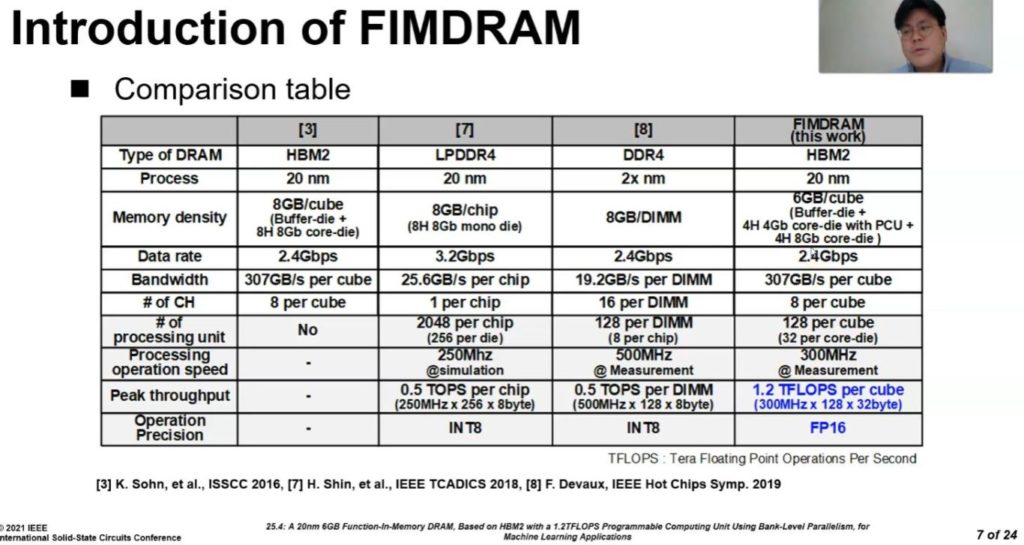

Samsung développe un nouveau type de mémoire HBM qui intègre des unités de traitement IA : la HBM-PIM (Processing In Memory). Cette mémoire serait donc capable de réaliser elle-même certains calculs qui incombent traditionnellement aux CPU, GPU ou autres FPGA ; il est question d’une puissance de 1,2 TFLOPS FP16. L’architecture permettrait de doubler les performances par rapport à un système avec de la mémoire HBM “classique” et de réduire la consommation d’énergie de 70 %.

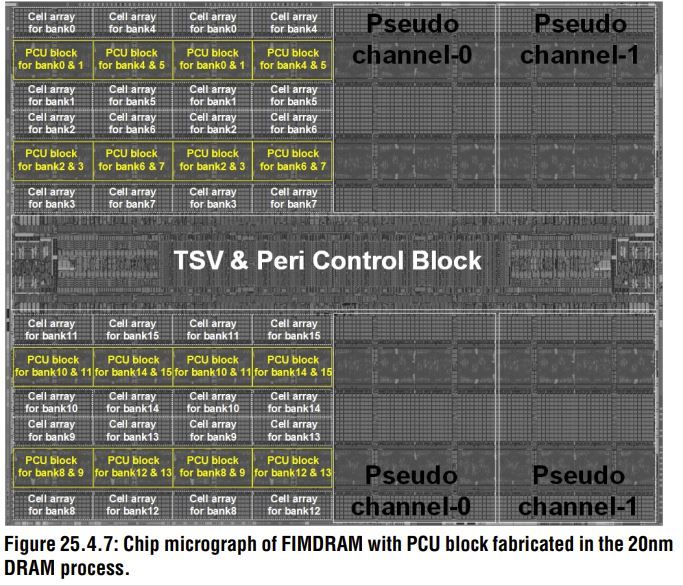

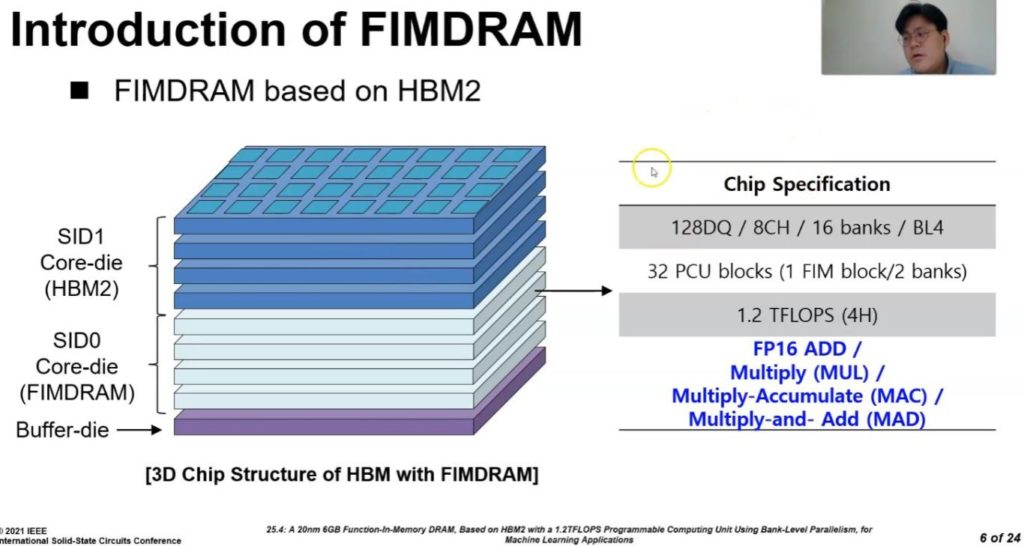

Chaque bank embarque une PCU (Programmable Computing Unit Block) cadencée à 300 MHz : en tout, il y a 32 PCU par puce. Naturellement, ces PCU prennent de la place : elles réduisent la capacité de moitié (4 Gb au lieu de 8 Gb pour de la mémoire HBM2 sans PCU). Samsung remédie partiellement à ce problème en combinant quatre puces avec PCU de 4 Gb et quatre puces sans PCU de 8 Gb, pour une capacité totale de 6 Go. Au passage, vous avez sûrement constaté que la documentation technique fait référence à une technologie FIMDRAM (Function-In Memory DRAM) ; il s’agit de l’appellation interne, le nom final pour cette mémoire est bien HMB-PIM.

SK Hynix présente sa mémoire HBM2E, plus rapide que celle de Samsung

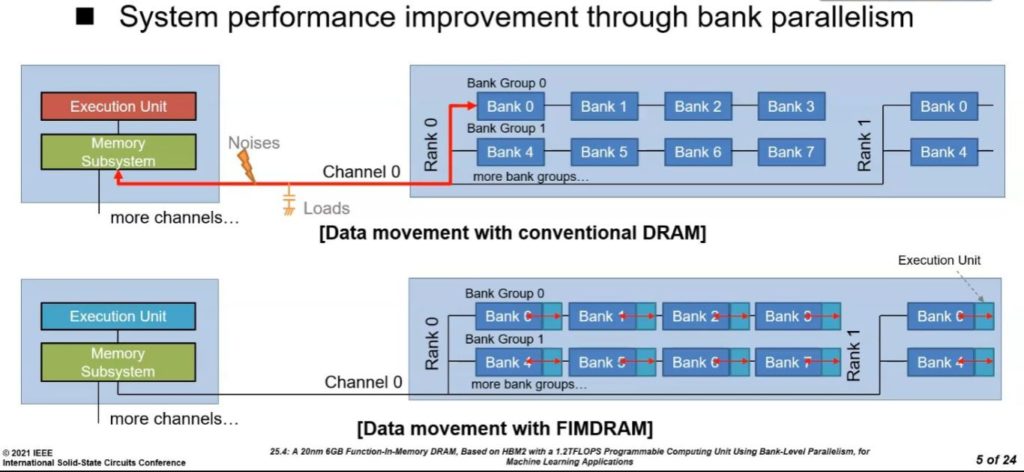

Éviter des transferts de données inutiles

L’idée qui sous-tend cette architecture est la suivante : éviter le transfert de données entre la mémoire et le processeur, coûteux en énergie et en temps. Ainsi, intégrer des PCU directement au sein de la mémoire supprime ces trajets ; cela fait gagner du temps, diminue la consommation et donc la chaleur générée. Un attribut décisif pour les puces HBM, souvent empilées les unes sur les autres au sein de systèmes dont le refroidissement n’est pas chose aisée.

Par ailleurs, Samsung indique que cette mémoire HMB-PIM ne “nécessite aucune modification des contrôleurs de mémoire conventionnels et de leurs protocoles de commande, ce qui rend la FIMDRAM idéale pour une adoption rapide par l’industrie”.

La mémoire HMB-PIM est actuellement en phase de tests dans des accélérateurs IA. Toutes les validations seront faites d’ici la fin du premier semestre 2021. Cependant, n’espérez pas la voir débarquer dans nos cartes graphiques rapidement : elle sera destinée aux secteurs du HPC, des centres de données et des applications mobiles IA dans un premier temps.

Kwangil Park, vice-président senior de la planification des produits de mémoire chez Samsung Electronics, déclare : “Notre HBM-PIM révolutionnaire est la première solution PIM programmable de l’industrie adaptée aux diverses charges de travail liées à l’IA telles que le HPC, la formation et l’inférence. Nous prévoyons de tirer parti de cette avancée en collaborant davantage avec les fournisseurs de solutions d’IA pour des applications PIM encore plus évoluées”.

Sources : Samsung, Tom’s Hardware US

Les chiffres semblent prometteurs. Cependant j’ai du mal à saisir l’intérêt d’optimiser sans cesse le Hardware, pendant que dans un autre temps le software se désoptimise de plus en plus ^^

Un exemple tout bête : le processeur multi-coeur est disponible au grand public depuis plus de 15 ans, et les programmes mono-coeur sont toujours très présents, surtout dans l’industrie.

Et je ne parle pas des codes “interprétés”, et autre couche logicielle qui se rajoute… et tous ces frameworks qui facilitent la vie des développeurs, au détriment choquant des rendements des logiciels !

A quoi bon doubler la puissance de calcul si on divise par deux le rendement du code ?!

Quand est-ce que l’on va sortir des benchmarks “nouveaux” (peut-être existent-ils ?) permettant de mesurer les performances d’un code logiciel ?