Dans un contexte mondial de sécheresse et de diminution des réserves d’eau, l’empreinte hydrique des IA génératives fait débat : un demi-litre d’eau serait consommé à chaque échange de 20 à 50 questions avec ChatGPT.

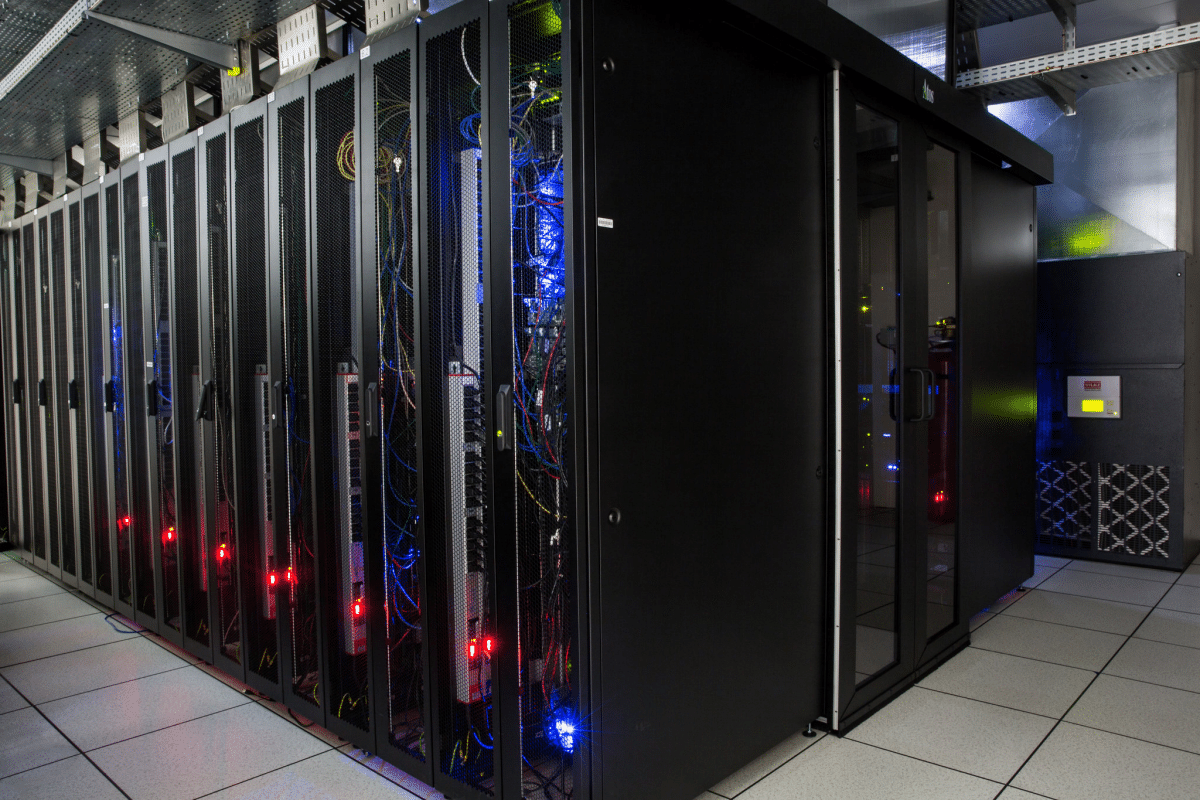

Devenu l’attraction technologique numéro un, l’agent conversationnel cache un impact environnemental non négligeable. En plus des 240 tonnes d’équivalent-CO₂ dues à la consommation électrique, aux coûts de fabrication et aux fuites de gaz réfrigérants, s’ajoute une consommation d’eau colossale. En cause, les systèmes de refroidissement des datacenters et les ressources en eau nécessaires à la production de l’électricité qui alimente les infrastructures.

Les IA comme ChatGPT, Google Bard ou le futur Apple GPT requièrent d’énormes centres de données pour fournir suffisamment de puissance de calcul à leur modèle algorithmique, qui leur permet ensuite de s’exprimer dans de nombreuses langues ou de répondre aux messages avec des images. La chaleur émise par les serveurs est régulée par des tours de refroidissement fonctionnant à l’eau. Cette solution est très courante, mais consomme d’énormes quantités de liquide.

L’impact hydrique de l’entrainement passé de GPT-3 est déjà conséquent : 700 000 litres ont été utilisés, soit la même quantité que pour refroidir un réacteur nucléaire. Mais au-delà de l’entrainement des IA, c’est à chaque requête que la facture d’eau s’alourdit.

A lire aussi : Microsoft veut utiliser toutes vos données pour perfectionner son IA et Edge

Une « petite » bouteille d’eau consommée à chaque conversation

Selon une étude publiée cette année par le chercheur Shaolei Ren de l’université de Californie, un échange standard de 20 à 50 questions avec le chatbot consomme environ 500 ml d’eau. Si cela ne semble pas alarmant, l’empreinte totale de ChatGPT devient extrême lorsqu’on considère l’ensemble des utilisateurs. En effet, 1,43 milliard de visites sur le site d’OpenAI ont été enregistrées lors de ces trente derniers jours. Selon l’étude, cela équivaut à 700 millions de litres d’eau.

« L’empreinte hydrique des modèles d’IA ne peut plus rester sous le radar » déclarent les chercheurs. Microsoft assure être en « recherche de solutions » pour mesurer et réduire leur consommation d’eau et d’énergie. La société rappelle ses objectifs pour 2030 : neutralité carbone, neutralité hydrique et zéro déchet. De même, OpenAI a déclaré qu’elle cherchait des moyens de rendre les LLM moins énergivores. Cependant, les chercheurs restent sceptiques face au lancement des nouvelles versions d’IA, comme GPT-4, qui demanderait quatre fois plus de ressources.

Source : AP