NVIDIA se lance dans l’intelligence artificielle et les LLM. Chat avec RTX, le nouveau chatbot de l’entreprise, est disponible en version démo. En revanche, bien qu’elle semble très compétente sur certains points, elle est également très exigeante.

L’intelligence artificielle est à la mode, c’est indéniable. Tout le monde s’y met, et de nombreuses entreprises proposent leur propre chatbot ou LLM (grand modèle de langage). Entre Google et Gemini et Bard, ou encore ChatGPT et OpenAI, les IA sont désormais omniprésentes.

Comme Apple et son LLM devant rivaliser avec ChatGPT, NVIDIA veut également faire partie du cercle des entreprises IA. En effet, la firme a récemment dévoilé un chatbot inédit : Chat with RTX. Cependant, contrairement au LLM conventionnel, l’intelligence artificielle de NVIDIA fonctionne directement depuis le PC de l’utilisateur.

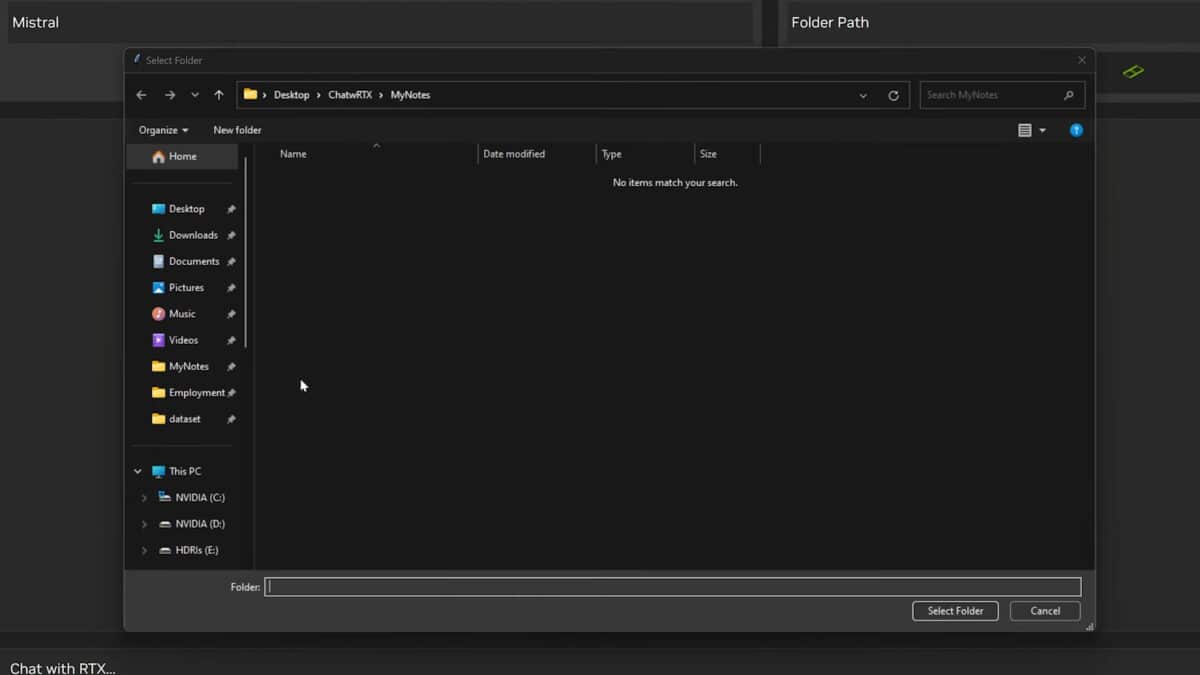

Désormais disponible en version démo, Chat with RTX permet aux utilisateurs d’alimenter l’IA avec des vidéos YouTube ainsi que leurs propres documents. Cela offre ainsi la possibilité de créer des résumés et d’obtenir des réponses pertinentes basées sur les données présentes sur la machine et non depuis Internet ou un serveur.

L’IA de NVIDIA travaille en local sur votre PC

Malheureusement, conçu pour fonctionner localement sur les PC, Chat avec RTX est assez exigeant. En effet, le chatbot requiert un GPU Nvidia de la série 30 ou 40 avec au moins 8 Go de mémoire. Une GeForce RTX 4070 Ti SUPER, par exemple.

L’objectif principal de Chat with RTX est de faciliter la recherche de données. L’intelligence artificielle est particulièrement utile dans le domaine du journalisme ou de la recherche. Elle permet de bénéficier d’une analyse et d’une synthèse d’une grande quantité de données très rapidement.

Par exemple, l’application s’est révélée efficace pour analyser des documents PDF. Elle semble offrir une bonne alternative aux systèmes existants tels que le système Copilot. En effet, l’IA de Microsoft semble avoir du mal avec ce type de fichier.

De plus, le fait d’être intégrée au système lui permet également d’évoluer en fonction du contenu présent sur le PC de l’utilisateur. Cela pourrait permettre une personnalisation plus poussée de l’IA à la manière des GPTs payants d’OpenAI.

Une IA trop buggée et trop exigeante ?

Cependant, Chat with RTX n’étant qu’en version démo, le chatbot peut être victime de bugs. C’est ce que rapportent certains utilisateurs qui signalent avoir rencontré des problèmes lors des retranscriptions de l’IA. Plus particulièrement lorsqu’il s’agit de contenu provenant de vidéos YouTube.

Qui plus est, l’intelligence artificielle, comme dit plus haut, est très exigeante. Son installation prendrait jusqu’à 30 minutes et nécessite un espace disque considérable, l’application occupant près de 40 Go. De plus, le chatbot consommerait environ 3 Go de mémoire vive lors de son utilisation.

Nvidia précise néanmoins que Chat with RTX est actuellement proposé aux développeurs principalement. Elle n’est pas encore une application finie destinée à tous les propriétaires de GPU Nvidia RTX. Il faut espérer que l’IA soit mieux optimisée lorsque celle-ci sera disponible au grand public.

En attendant, il est peu probable qu’elle supplante ses rivales présentes sur le marché. Les contraintes qui lui sont liées semblent trop importantes pour lui permettre de percer. Si elle est plus performante sur certains points, un utilisateur lambda lui préférera certainement un LLM plus accessible comme ChatGPT ou Bard.

- NVIDIA vient de dévoiler une nouvelle IA maison, Chat with RTX, similaire à Bard ou ChatGPT.

- Le chatbot fonctionne depuis le PC de l’utilisateur et demande une carte graphique RTX série 30 ou 40.

- L’IA est très exigeante, prend 40 d’espace de stockage et consomme environ 3 Go de mémoire vive.