Au menu : des GPU “Ampere Next” prévus en 2022 ; un CPU Grave basé sur ARM ; de nouvelles cartes RTX professionnelles, une puce DRIVE Atlan ou encore des DPU BlueField.

À l’occasion de la GTC 2021, Jensen Huang, PDG de NVIDIA, a annoncé plusieurs produits et fixé le cap des prochaines années en matière de GPU, CPU et DPU. Vous pouvez voir l’intégralité de la conférence ci-dessous.

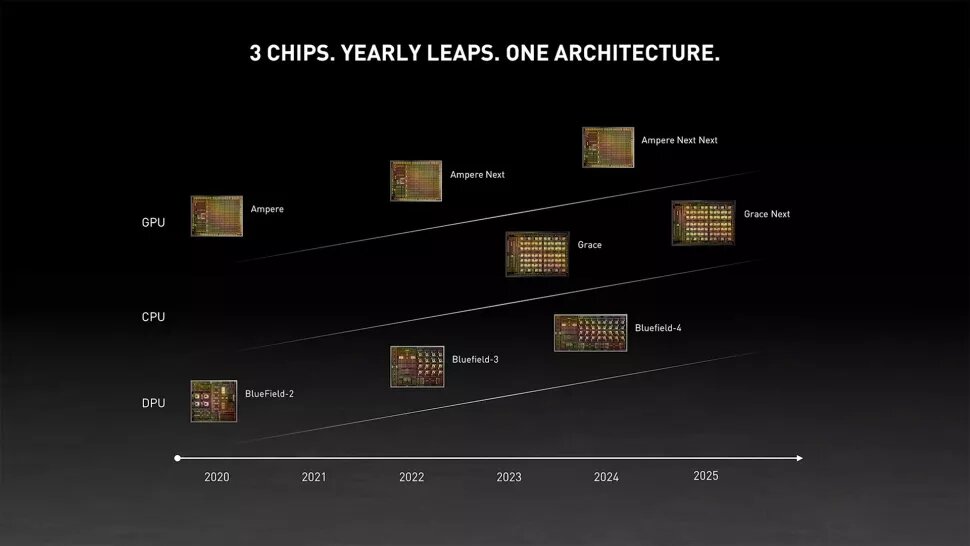

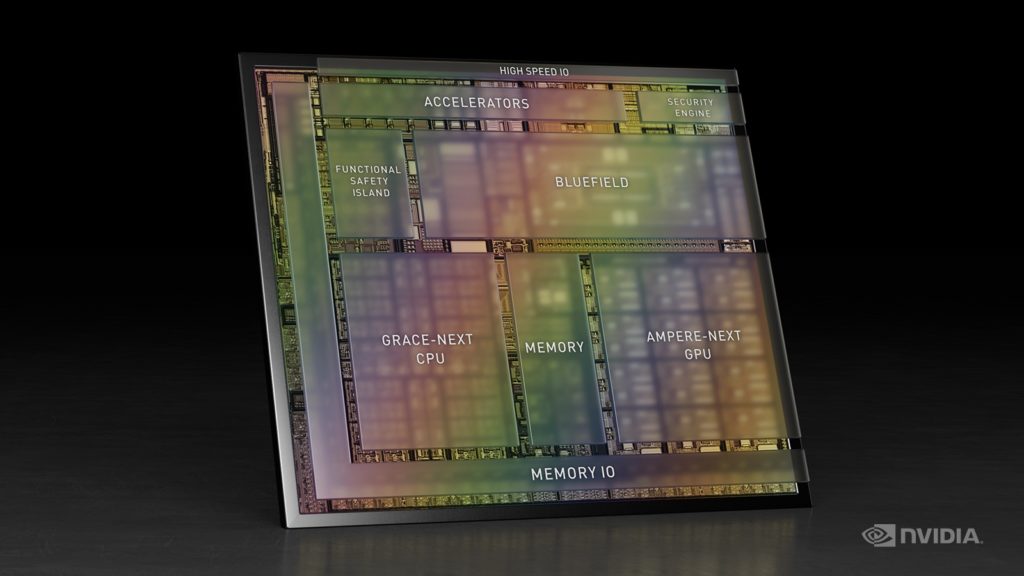

Commençons par le sujet qui intéresse sans doute le plus les joueurs : les GPU. L’entreprise a lancé son architecture Ampere l’année dernière. La prochaine génération, dissimulée sous l’appellation “Ampere Next”, arrivera l’année prochaine, en 2022. Elle sera remplacée deux ans plus tard, en 2024, par “Ampere Next Next”. Il est probable qu’Ampere Next désigne l’architecture des GPU répondant au nom de code Hopper.

Nous savons donc désormais une chose : contrairement à certaines rumeurs, Ampere n’aura pas de successeur dès cette année. Pour la suite, NVIDIA n’a pas fourni d’informations concernant les améliorations ou le nœud de gravure utilisé. Au niveau de la finesse de gravure, les GPU Ampere pour centres données sont fabriqués en 7 nm par TSMC (GA100) ; les RTX 3000 le sont par Samsung en 8 nm.

Pour Hopper, il semble plausible que les GPU pour centres de données passent au N5 de TSMC. En revanche, pour les GPU grand public, les RTX 4000, le choix du fondeur et du nœud de gravure restent incertains ; avec la situation mondiale actuelle, la capacité de production de TSMC ou de Samsung à cette période pourrait devenir un facteur encore plus déterminant que par le passé. Quant à “Ampere Next Next”, mystère, y compris au sujet du nom de code de la future architecture.

CPU Grace

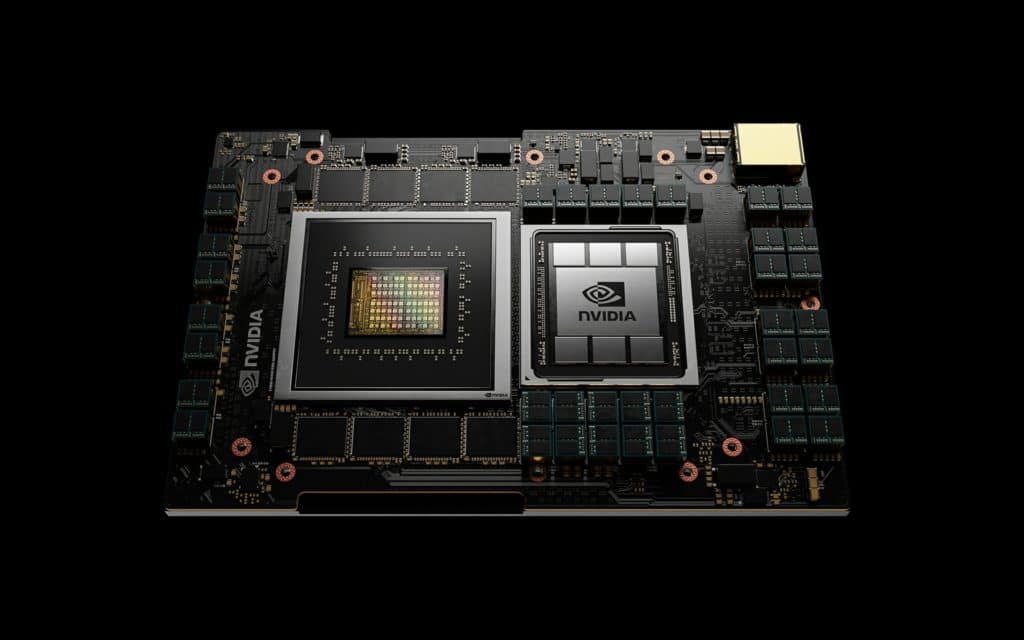

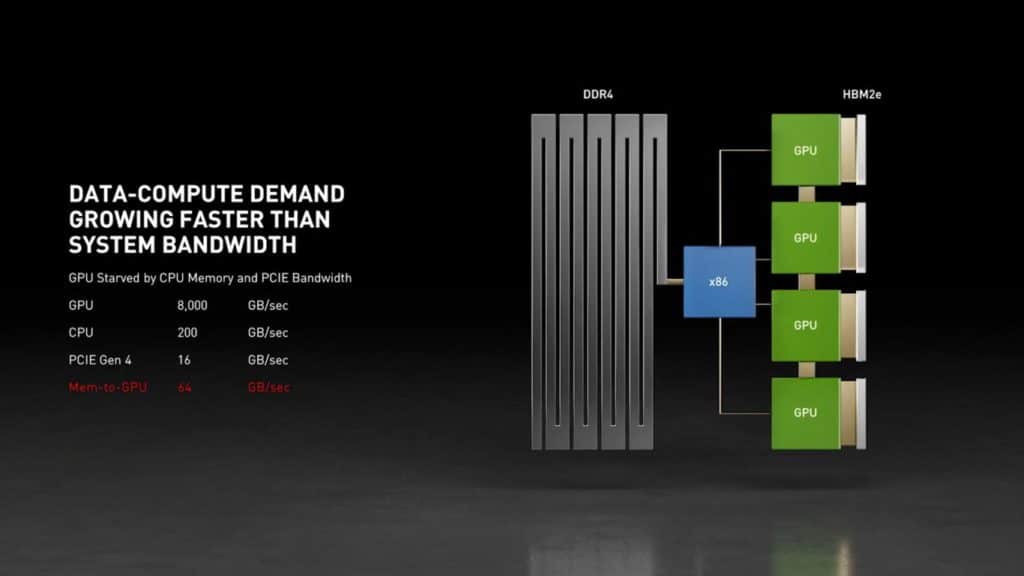

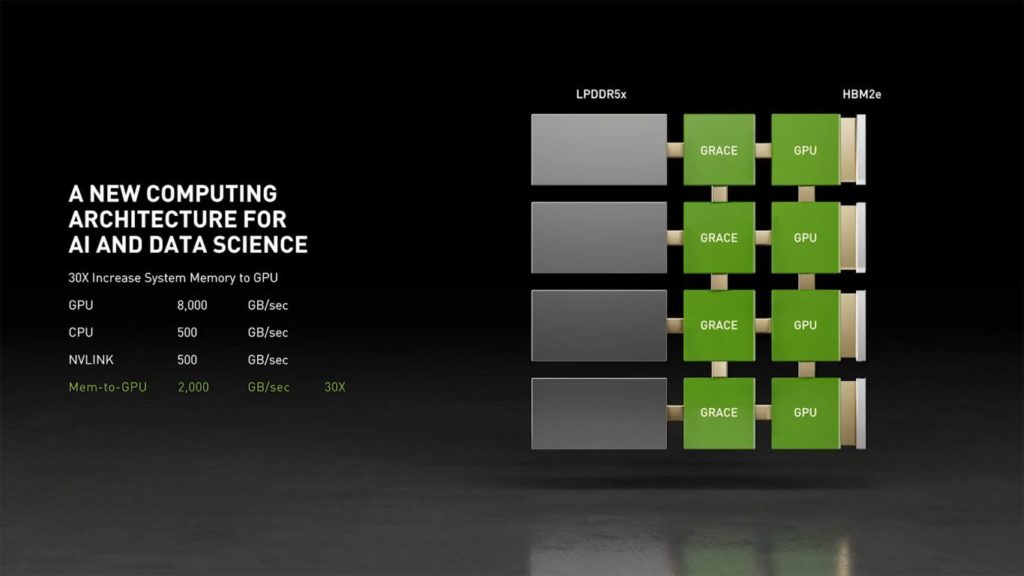

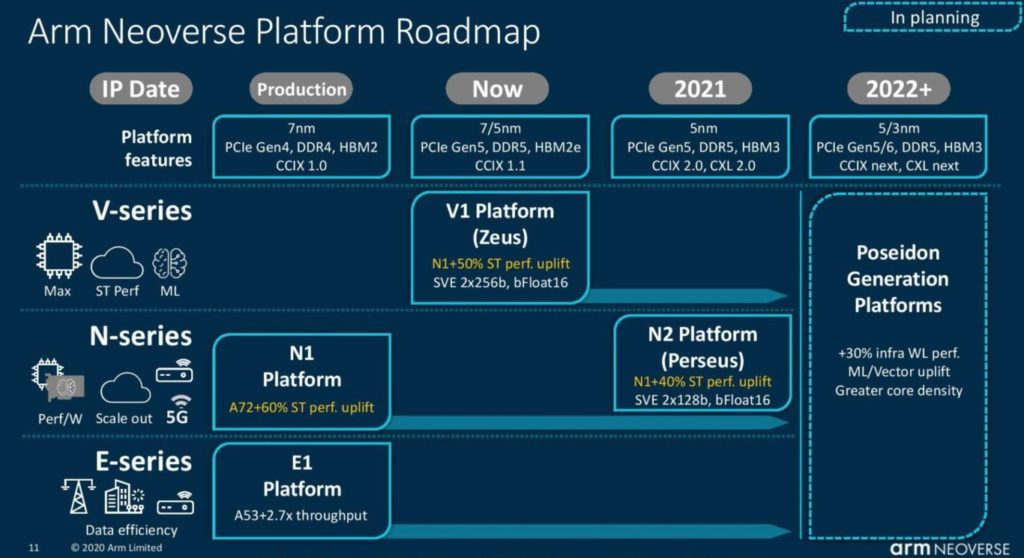

La ligne CPU sur l’image ci-dessus vous aura certainement interpelé : NVIDIA prépare un processeur ARM intitulé Grace. La société présente Grace comme son premier CPU pour les centres de données et promet des performances 10 fois supérieures à celles des serveurs les plus rapides d’aujourd’hui dans les charges de travail d’IA et de HPC.

Grace hérite de cœurs de CPU ARM Neoverse de “nouvelle génération” non spécifiés. Il s’agit peut-être des cœurs V1 Zeus. Selon ARM, ces derniers offrent une hausse des IPC de 50 % par rapport aux cœurs Neoverse N1 actuels. La plateforme Arm V1 prend en charge l’interface PCIe 5.0 et les mémoires DDR5, HBM2e et HBM3. En matière d’interconnexion GPU, NVIDIA semble privilégier le NVLink au CCIX 1.1.

Les CPU Grace équiperont notamment deux supercalculateurs commandés par le CSCS et le Los Alamos National Laboratory. Ces derniers seront construits en partenariat avec Hewlett Packard Enterprise. Ils doivent être mis en service à partir de 2023.

Enfin, en 2025, NVIDIA prévoit une version plus puissante de ce CPU, “Grace Next”.

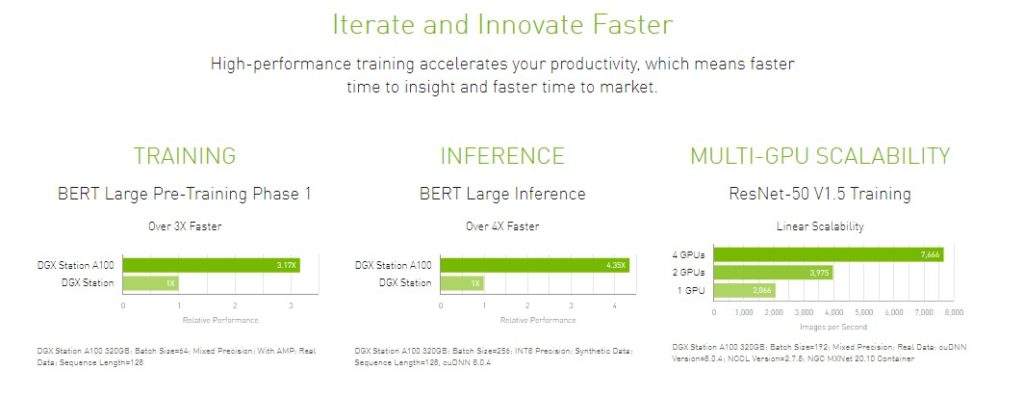

DGX A100 320G et DGX Superpod

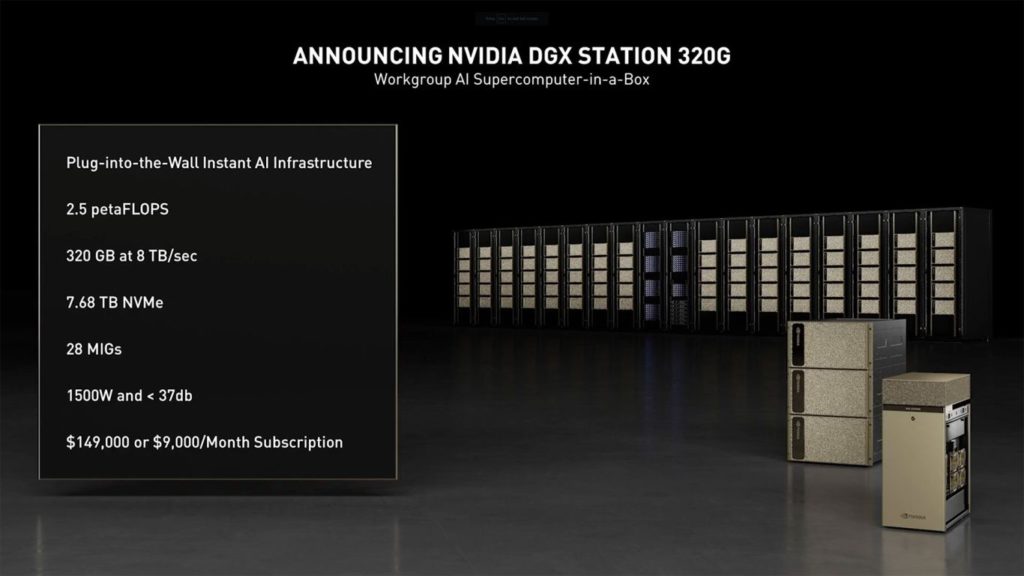

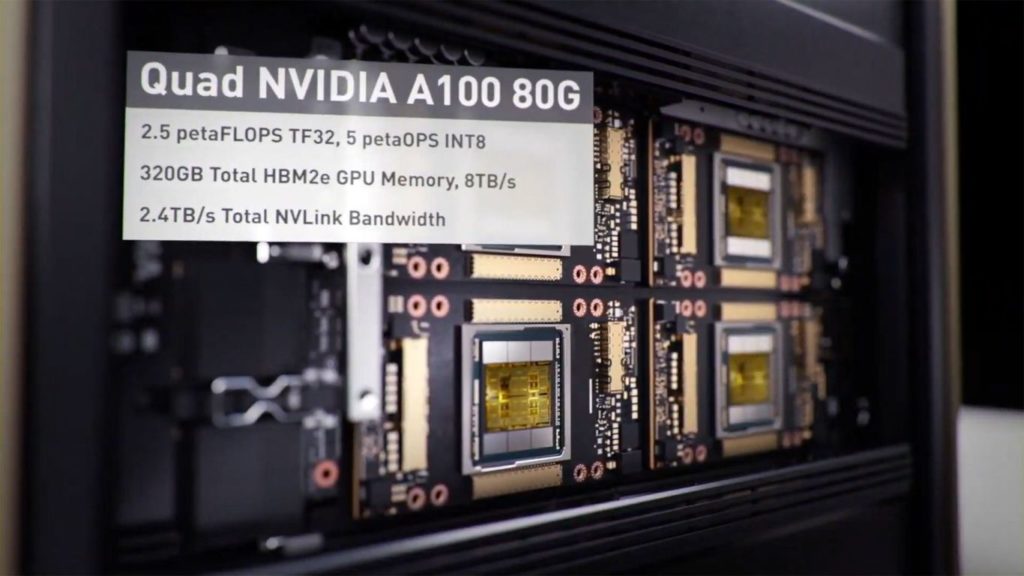

En novembre dernier, NVIDIA avait présenté sa DGX Station A100 320G armée de quatre GPU A100, chacun doté de 80 Go de mémoire HMB2e, et d’un processeur AMD EPYC 7742 à 64 cœurs. Celle-ci est désormais officiellement lancée.

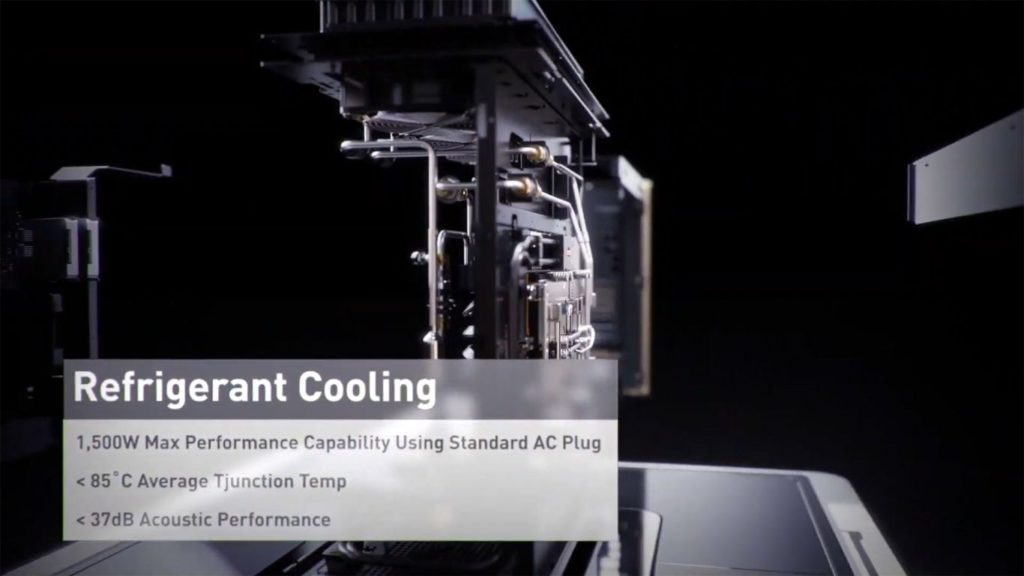

Cette machine atteint une puissance de calcul FP32 de 2,5 PFLOPS. Comme son nom et le nombre de GPU le préfigurent, elle contient 320 Go de mémoire HBM2e en tout. À cela s’ajoutent 512 Mo de DDR4-3200 et un SSD NVMe de 7,68 To. Malgré une consommation avoisinant les 1500W, le volume sonore en fonctionnement n’excède pas 37 dBA.

Pour acquérir cette DGX Station A100, les clients ont deux options : l’acheter 149 000 dollars ou la louer 9000 dollars par mois.

Par ailleurs, NVIDIA a aussi mis à jour son DGX SuperPOD. Il reçoit désormais des GPU A100 de 80 Go, des DPU Bluefield-2 (Data Processing Units) et peut être utilisé avec le logiciel Base Command.

Le DGX Superpod embarque de 20 à 140 systèmes DGX A100. Chaque système contient deux processeurs EPYC 7742 et 8 GPU A100. Prix du DGX Superpod le moins onéreux : 7 millions de dollars. La facture peut s’envoler à 60 millions de dollars pour les versions les mieux dotées.

A30 et A10

L’A100 ne sera plus la seule solution Ampere destinée aux centres de données. En effet, elle est rejointe par deux petites sœurs, les A30 et A10. La première est munie de 24 Go de mémoire HMB2 et la seconde de la même quantité mais de type GDDR6. Toutes les spécifications sont rassemblées dans le tableau ci-dessous.

| Solution | A100 PCIe | A30 | A10 |

| GPU | GA100 | GA100 | GA102-890 |

| FP64 | 9,7 TFLOPS | 5,2 TFLOPS | – |

| FP64 cœurs Tensor | 19,5 TFLOPS | 10,3 TFLOPS | – |

| FP32 | 19,5 TFLOPS | 10,3 TFLOPS | 31,2 TFLOPS |

| TF32 | 156 TF | 82 TF | 62,5 TFLOPS |

| Bfloat16 | 312 TF | 165 TF | 125 TF |

| FP16 Cœurs Tensor | 312 TF | 165 TF | 125 TF |

| INT8 | 624 TOPS | 330 TOPS | 250 TOPS |

| INT4 | 1248 TOPS | 661 TOPS | 500 TOPS |

| Cœurs RT | – | – | 72 |

| Mémoire | 40 Go HBM2 | 24 Go HBM2 | 24 Go GDDR6 |

| Bande passante mémoire | 1,555 Go/s | 933 Go/s | 600 Go/s |

| Interconnexion | 12 NVLinks, 600 Go/s | ? NVLinks, 200 Go/s | – |

| Multi-Instance GPU (MIG) | 7 MIGs @ 5 Go | 4 GPU @ 6 Go chacun 2 GPU @ 12 Go chacun 1 GPU @ 24 Go | – |

| Optical Flow Acceleration | – | 1 | – |

| NVJPEG | – | 1 decoder | ? |

| NVENC | – | ? | 1 encoder |

| NVDEC | – | 4 decoders | 1 decoder (+AV1) |

| Facteur de forme | FHFL | FHFL | FHFL |

| TDP | 250W | 165W | 150W |

NVIDIA : le GPU Ampere GA100 bientôt intégré à la gamme CMP HX ?

RTX A4000 et A5000 pour ordinateurs fixes

NVIDIA étoffe également sa gamme de cartes pour les professionnels, anciennement connue sous le nom Quadro. La RTX A6000 cohabitera d’ici la fin du mois avec les RTX A5000 et RTX A4000, deux références croisées il y a peu.

| Carte graphique | NVIDIA RTX A4000 | NVIDIA RTX A5000 | NVIDIA RTX A6000 |

| GPU | Ampere GA106 GPU | Ampere GA102 GPU | Ampere GA102 GPU |

| Nœud de fabrication | Samsung 8 nm | Samsung 8 nm | Samsung 8 nm |

| Surface du die | 276 mm² | 628 mm² | 628 mm² |

| Cœurs GPU | 6144 | 8192 | 10 752 |

| Cœurs Tensor | 192 | 256 | 336 |

| Fréquence de base | ? | ? | 1860 MHz |

| FP32 | ? | ? | 40 TFLOPs |

| VRAM | 16 Go GDDR6 | 24 Go GDDR6 | 48 Go GDDR6 |

| Bus mémoire | 256-bit | 384-bit | 284-bit |

| Bande passante mémoire | 448 Go/s | 768 Go/s | 768 Go/s |

| TDP | 140W | 230W | 300W |

| Prix de lancement | TBC | TBC | 4650 dollars |

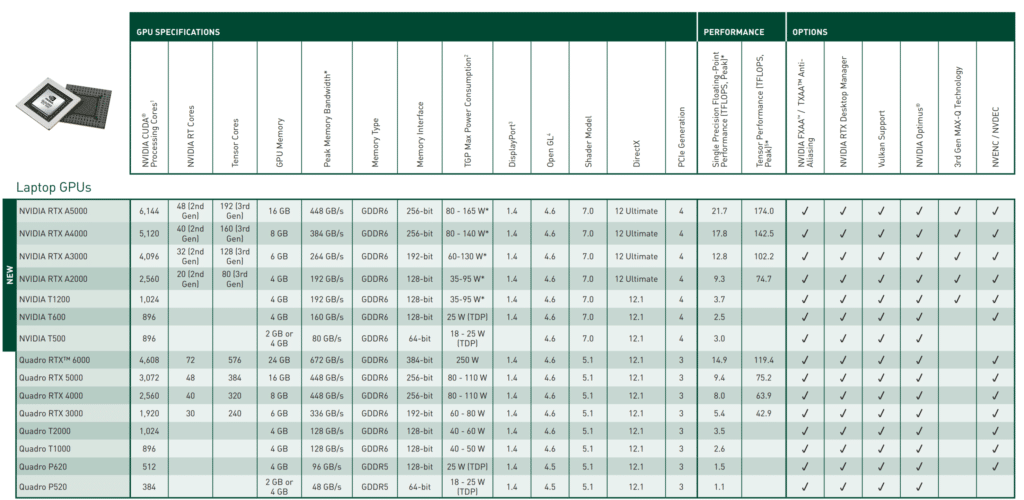

RTX A5000, A4000, A3000 et A2000 pour ordinateurs portables

Sur le marché des ordinateurs portables, NVIDIA dégaine quatre modèles, les RTX A5000, A4000, A3000 et A2000. L’entreprise indique que les premières machines équipées de telles cartes arriveront au cours du trimestre.

| Carte graphique | RTX A2000 | RTX A3000 | RTX A4000 | RTX A5000 |

| GPU | GA107 | GA104 | GA104 | GA102 |

| Nombre de transistors | 12 milliards | 17,4 milliards | 17,4 milliards | 28 milliards |

| Nœud de fabrication | Samsung 8 nm | Samsung 8 nm | Samsung 8 nm | Samsung 8 nm |

| Surface du die | 276 mm² | 392,5 mm² | 392,5 mm² | 628,4 mm² |

| SMs | 20 | 32 | 40 | 48 |

| FP32 ALUs | 2560 | 4096 | 5120 | 6144 |

| INT32 ALUs | 1280 | 2048 | 2560 | 3072 |

| Cœurs Tensor | 80 | 128 | 160 | 192 |

| Cœurs RT | 20 | 32 | 40 | 48 |

| FP32 performance | 9,3 TFLOPS | 12,8 TFLOPS | 17,8 TFLOPS | 21,7 TFLOPS |

| RT performance | 18,2 TFLOPS | 25,0 TFLOPS | 34,8 TFLOPS | 75,6 TFLOPS |

| Tensor performance | 74,7 TFLOPS | 102,2 TFLOPS | 142,5 TFLOPS | 174,0 TFLOPS |

| VRAM | 4 Go GDDR6 | 6 Go GDDR6 | 8 Go GDDR6 | 16 Go GDDR6 |

| Interface mémoire | 128-bit | 192-bit | 256-bit | 256-bit |

| Bande passante mémoire | 192 Go / s | 264 Go / s | 384 Go / s | 448 Go / s |

| TDP | 35 – 95 W | 60 – 130 W | 80 – 140 W | 80 – 165 W |

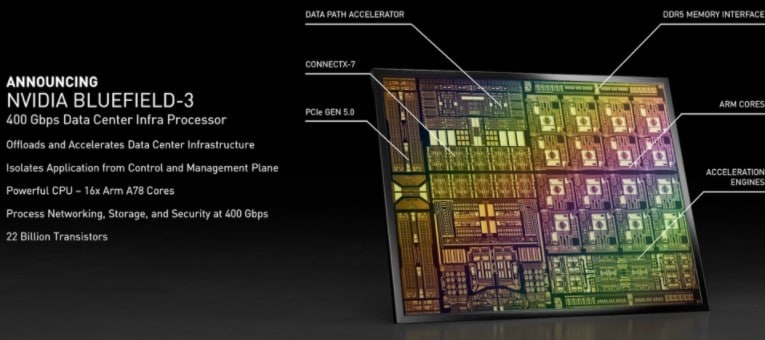

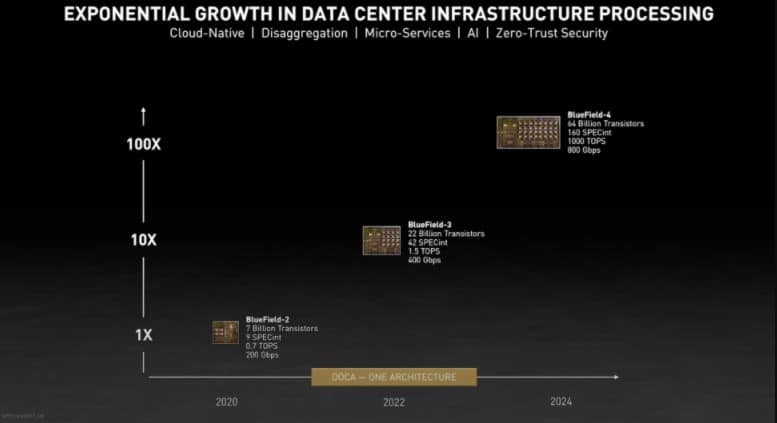

DPU BlueField-3 et BlueField-4

NVIDIA a présenté deux DPU : le BlueField-3 attendu en 2022 et le BlueField-4 prévu pour 2024. Proposé en formats HHHL et FHHL, le DPU BlueField-3, fruit du travail des équipes de Mellanox, se compose de 22 milliards de transistors. Il embarque 16 cœurs Arm Cortex-A78, plusieurs accélérateurs et 16 Go de mémoire DDR5. Son niveau de performances est de 42 SPECrate2017_int et 1,5 TOPS. Cela le place à peu près au niveau d’un processeur Xeon Scalable Cascade Lake à 12 cœurs. Son successeur, le BlueField-4 et ses 64 milliards de transistors atteindrait 160 SPECrate2017_int et 1000 TOPS.

NVIDIA DRIVE Atlan

Enfin, terminons ce tour d’horizon avec un produit destiné au secteur automobile, le NVIDIA Drive Atlan. Cette puce vise les 1000 TOPS et devrait être intégrée dans des véhicules autonomes à partir de 2025.

Selon l’entreprise, “DRIVE Atlan comprendra l’architecture GPU de nouvelle génération de NVIDIA, des nouveaux cœurs de CPU Arm, ainsi que des accélérateurs d’apprentissage profond et de vision par ordinateur”. Cela lui accorde des “performances comparables à celles d’un centre de données” et offre “aux constructeurs automobiles de vastes capacités de calcul pour construire des véhicules richement programmables et perpétuellement évolutifs grâce à des mises à jour over-the-air sécurisées”.

Sources : NVIDIA, Tom’s Hardware US, WCCFTech

Je peu me tromper mais pour moi c’est un premier pas pour la sortie d’un cpu arm nvidia pour le grand public d’içi quelques années ,ils ont les planches les clous et le trous est creuser reste plus qu’a enterrer intel

la plaque de cuisson derrière lui ! j’adooooooooore